LangGraph 状态管理实战:2026年 Agent 架构最佳实践

凌晨三点,我的 Agent 在第 27 次重试后终于崩溃了。状态数据丢失,对话上下文断裂,用户等待超时——这是我把 MemorySaver 带上生产的代价。

LangGraph 的 GitHub 仓库已经突破 30,000 stars,成为 2026 年最活跃的 Agent 框架。但说实话,很多人的 LangGraph 使用还停留在”能跑起来就行”的阶段。状态冲突、持久化失败、生产部署困难,这些问题在教程里很少被提及,却在真实项目中反复出现。

LangChain 官方在 2026 年发布了 State of Agent Engineering 报告,里面有个数据让我印象深刻:超过 60% 的 Agent 生产事故与状态管理有关。这篇文章就想聊聊这些”教程不会告诉你的事”——State Schema 设计模式、Reducer 函数实战、持久化方案选型、框架对比决策,以及 Observability 集成。读完你会有可直接用的代码模板,还有选择框架的决策依据。

LangGraph 状态管理核心:从 StateGraph 到 Reducer

如果你之前用过 LangChain 的 Chain,可能会对 StateGraph 感到陌生。Chain 是线性的——一步接一步,像流水线。但真实的 Agent 逻辑很少这么老实:你可能需要在某个节点判断”用户意图是闲聊还是查询”,然后跳转到不同的分支;或者多个节点并行执行,最后汇总结果。这就是 StateGraph 存在的意义。

1.1 StateGraph 构建模式

StateGraph 和普通 Graph 的核心区别在于”状态”二字。普通 Graph 的节点之间传递的是固定的输入输出,而 StateGraph 的所有节点共享同一个状态对象。每个节点可以读取状态、修改状态,修改后的状态自动传递给下一个节点。

from langgraph.graph import StateGraph, MessagesState

from langchain_openai import ChatOpenAI

# 定义状态结构(继承 MessagesState,自动包含 messages 字段)

class AgentState(MessagesState):

next_action: str # 下一步动作

retry_count: int = 0 # 重试次数

# 初始化图

graph = StateGraph(AgentState)

# 添加节点

graph.add_node("classify", classify_intent)

graph.add_node("respond", generate_response)

graph.add_node("fallback", handle_fallback)

# 定义边(条件分支)

graph.add_conditional_edges(

"classify",

lambda state: state["next_action"],

{

"respond": "respond",

"fallback": "fallback"

}

)

# 编译——这一步必须,不编译无法执行

app = graph.compile().compile() 这个方法很多人会漏掉。我刚用 LangGraph 的时候也踩过坑——写了半天节点和边,运行时直接报错 “Graph not compiled”。编译会做类型检查、边连通性验证,还会根据配置注入 checkpointer。

有个细节值得注意:StateGraph 的状态是”增量更新”的,而不是”完全覆盖”。比如你在节点 A 修改了 retry_count,节点 B 只需要读这个字段,不需要关心其他状态。这个设计让并行执行成为可能——多个节点同时运行,各自修改不同的状态字段,最后合并结果。

1.2 状态 Schema 设计进化

定义状态结构有三种方式,各有优劣。

TypedDict 是最基础的,类型安全但不支持默认值:

from typing import TypedDict, Annotated

class SimpleState(TypedDict):

messages: list

context: str

# 不支持默认值,每个字段都必须标注类型dataclass 支持 Python 原生默认值,IDE 提示友好:

from dataclasses import dataclass

@dataclass

class DataclassState:

messages: list

context: str = ""

retry_count: int = 0 # 可以有默认值Pydantic BaseModel 是 2026 年的推荐方式。它支持递归验证、类型转换,还能和 LangChain 的工具无缝集成:

from pydantic import BaseModel, Field

class OptimizedState(BaseModel):

messages: list = Field(default_factory=list)

context: str = ""

retry_count: int = Field(default=0, ge=0) # 支持校验:必须 >= 0

class Config:

# Pydantic v2 的配置

extra = "forbid" # 禁止额外字段,防止状态污染说实话,我之前一直用 TypedDict,觉得够用了。直到有一次,Agent 运行时混入了非法字段(调试时临时加的,忘了删),导致后续节点拿到莫名其妙的数据,排查了半天才定位到。从那以后,我改用 Pydantic 的 extra="forbid" 配置,让非法字段在入口就被拦截。

1.3 Reducer 函数机制详解

这是 LangGraph 状态管理最核心、也最容易被误解的部分。

当多个节点并行执行时,它们可能同时修改同一个状态字段。LangGraph 默认的行为是”后执行覆盖先执行”,但这往往不是你想要的。Reducer 函数定义了如何合并这些并行修改。

LangGraph 内置了一个常用的 reducer:add_messages。它用于消息列表的合并——自动去重,保留最新版本:

from langgraph.graph import add_messages

class ChatState(TypedDict):

messages: Annotated[list, add_messages]当你有两个并行节点分别追加消息到 messages,add_messages 会智能合并,而不是简单覆盖。

自定义 Reducer 其实就是一个接收两个参数的函数:当前值和新值。返回合并后的结果。

def merge_contexts(existing: str, new: str) -> str:

"""合并上下文字符串,保留最长版本"""

if not existing:

return new

if not new:

return existing

return existing if len(existing) >= len(new) else new

class CustomState(TypedDict):

context: Annotated[str, merge_contexts]我在一个项目中用过自定义 reducer 来处理”多路召回”的场景。三个检索节点并行查询向量库、关键词索引、知识图谱,各自返回候选结果列表。最后用 reducer 合并去重、按相关性排序。这种方式比串行调用快了将近 3 倍。

持久化与检查点:生产级 Agent 的基石

引言里提到的凌晨崩溃事件,根本原因就是我没正确配置持久化。MemorySaver 只是把状态存在内存里,进程重启就没了。Agent 运行到一半崩溃,用户对话全部丢失——这种事故在生产环境是不可接受的。

2.1 Checkpointer 类型与选型

LangGraph 提供了三种 Checkpointer,适用场景差异很大。

| Checkpointer | 适用场景 | 优点 | 缺点 |

|---|---|---|---|

| MemorySaver | 本地开发、快速测试 | 零配置、极快 | 进程重启丢失 |

| SqliteSaver | 单机部署、原型验证 | 轻量、无需外部依赖 | 写性能有限,不适合高并发 |

| PostgresSaver | 生产环境 | 可靠、支持高并发 | 需要维护 PostgreSQL |

我强烈建议:开发阶段用 MemorySaver,生产环境直接上 PostgresSaver。跳过 SqliteSaver——它的写性能瓶颈在高并发场景会让你怀疑人生。

# 生产环境配置示例

from langgraph.checkpoint.postgres import PostgresSaver

import psycopg

# 同步版本

conn = psycopg.connect("postgres://user:pass@host:5432/db")

checkpointer = PostgresSaver(conn)

# 异步版本(推荐用于高并发)

from langgraph.checkpoint.postgres.aio import AsyncPostgresSaver

import psycopg_pool

pool = psycopg_pool.AsyncConnectionPool(

"postgres://user:pass@host:5432/db",

min_size=5,

max_size=20

)

async_checkpointer = AsyncPostgresSaver(pool)

# 编译时注入

app = graph.compile(checkpointer=async_checkpointer)2.2 Thread ID 机制

Thread ID 是 LangGraph 多用户/多会话隔离的核心机制。每个 thread_id 对应独立的状态历史,互不干扰。

# 第一次对话

config = {"configurable": {"thread_id": "user_123_session_1"}}

result = app.invoke(

{"messages": [{"role": "user", "content": "我叫小明"}]},

config

)

# 第二次对话(同一个 thread_id)

# Agent 会记住之前说的"我叫小明"

result2 = app.invoke(

{"messages": [{"role": "user", "content": "我叫什么名字?"}]},

config # 同一个 thread_id

)

# 不同 thread_id = 完全独立的新会话

config_new = {"configurable": {"thread_id": "user_456_session_1"}}

result3 = app.invoke(

{"messages": [{"role": "user", "content": "我叫什么名字?"}]},

config_new # Agent 不知道"小明"

)这个机制很巧妙,但也容易用错。我曾经犯过一个错误:把 thread_id 设成固定值,结果所有用户共享同一个对话历史——用户 A 问的问题,用户 B 看到了答案。正确的做法是用 用户ID + 会话ID 组合作为 thread_id。

自动保存和自动加载是 checkpointer 的另一个”隐式”特性。你不需要手动调用 save() 或 load(),每次 invoke() 或 stream() 调用都会自动触发。这很方便,但也意味着你的数据库要扛住频繁写入。

2.3 序列化与类型支持

LangGraph 默认使用 JsonPlusSerializer 序列化状态。它支持:

- Python 原生类型(list, dict, str, int, float, bool)

- datetime 对象

- LangChain 消息类型(HumanMessage, AIMessage 等)

- enum 枚举值

from datetime import datetime

from langchain_core.messages import HumanMessage

class RichState(TypedDict):

messages: list

created_at: datetime # 支持 datetime

status: str

# 可以直接存 datetime,不需要转成字符串

state = {

"messages": [HumanMessage(content="Hello")],

"created_at": datetime.now(),

"status": "active"

}但有些类型是不支持的,比如 Python 的 set(集合)。如果你的状态里有 set,得自己转成 list,读取时再转回去。我在一个项目中用 set 存已访问的节点 ID,结果序列化时报错,花了好一会才定位到。

2.4 生产部署避坑指南

陷阱一:SqliteSaver 写性能

SQLite 的写锁是数据库级别的,同一时刻只能有一个写操作。如果你的 Agent 需要处理 100+ 并发对话,SqliteSaver 会成为瓶颈。表现是:用户请求变慢,错误率上升,日志里全是 “database is locked”。

解决方法:直接上 PostgreSQL,用异步版本 AsyncPostgresSaver。

陷阱二:异步 API 选择

LangGraph 的同步和异步 API 是分开的。如果你的应用是异步框架(FastAPI、aiohttp),务必使用异步版本:

# 同步 API(阻塞)

result = app.invoke(state, config)

# 异步 API(非阻塞)

result = await app.ainvoke(state, config)

# 流式输出也需要对应的异步方法

async for chunk in app.astream(state, config):

yield chunk混用同步和异步会出问题。我曾经在 FastAPI 路由里调用了同步的 invoke(),结果阻塞了整个事件循环,其他请求全部卡住。

陷阱三:错误恢复机制缺失

Checkpointer 会保存状态,但它不是自动的失败检测器。如果你的 Agent 在节点 C 崩溃,状态会停留在节点 C 之前,但你需要自己实现”从断点恢复”的逻辑:

# 从上次中断的地方恢复

state = app.get_state(config)

if state.values.get("current_node") == "C":

# 重新执行节点 C

result = app.invoke(state.values, config)LangGraph 提供了 app.get_state() 和 app.update_state() API,让你可以读取和手动修改状态。这对调试很有用——你可以”回滚”到某个检查点重新执行。

框架对比:LangGraph vs CrewAI vs AutoGen

选框架就像选编程语言,没有”最好”只有”最适合”。这三个框架我都在项目中用过,各有各的脾气。

3.1 三框架设计哲学

LangGraph:图结构 + 状态驱动

LangGraph 的核心理念是”显式图结构”。你定义节点、边、状态,框架负责执行。好处是控制力极强——你清楚知道数据怎么流转、在哪个节点做了什么决策。坏处是学习曲线陡峭,代码量相对多。

# LangGraph 风格:显式定义每个节点和边

graph = StateGraph(AgentState)

graph.add_node("research", research_node)

graph.add_node("write", write_node)

graph.add_node("review", review_node)

graph.add_edge("research", "write")

graph.add_conditional_edges("write", should_review, {"review": "review", "end": END})CrewAI:角色驱动 + 高抽象

CrewAI 的思路是”定义角色,让他们协作”。你定义 Agent(角色)、Task(任务)、Crew(团队),框架自动编排。上手很快,几行代码就能跑。但控制力弱——底层的编排逻辑被封装了,出问题时调试困难。

# CrewAI 风格:定义角色和任务

researcher = Agent(role="Researcher", goal="Find information", ...)

writer = Agent(role="Writer", goal="Write articles", ...)

task1 = Task(description="Research topic X", agent=researcher)

task2 = Task(description="Write article based on research", agent=writer)

crew = Crew(agents=[researcher, writer], tasks=[task1, task2])

crew.kickoff() # 一行启动AutoGen:对话驱动 + 协作

AutoGen 来自微软研究院,核心是”Agent 之间的对话”。你定义多个 Agent,它们通过对话协作完成任务。适合需要频繁沟通、协商的场景,比如代码审查、方案讨论。但 Token 消耗高——Agent 之间的对话会占用大量上下文。

# AutoGen 风格:Agent 通过对话协作

assistant = AssistantAgent("assistant", llm_config=...)

user_proxy = UserProxyAgent("user_proxy", ...)

# Agent 之间自动对话

user_proxy.initiate_chat(

assistant,

message="帮我写一个排序算法"

)

# assistant 和 user_proxy 会自动多轮对话,直到任务完成3.2 技术维度对比表

我根据实际使用经验,从几个维度做了对比:

| 维度 | LangGraph | CrewAI | AutoGen |

|---|---|---|---|

| 学习曲线 | 陡峭 | 平缓 | 中等 |

| 控制力 | 极强 | 中等 | 中等 |

| 生产成熟度 | 最成熟 | 稳定 | 改进中 |

| 状态管理 | 原生支持 | 封装 | 封装 |

| 调试能力 | 强(可视化 trace) | 中等 | 中等 |

| Token 效率 | 高 | 中等 | 低(对话开销大) |

| 并行执行 | 原生支持 | 支持 | 支持 |

| 持久化 | 多种后端 | 有限 | 有限 |

| 文档质量 | 详尽 | 一般 | 一般 |

学习曲线:CrewAI 最友好,定义角色就完事。LangGraph 需要理解 StateGraph、Reducer、Checkpointer 等概念,上手周期更长。

控制力:LangGraph 胜出。你可以精确控制每个节点的输入输出、条件分支、并行执行。CrewAI 和 AutoGen 的编排逻辑被封装,出问题时难以定位。

Token 效率:AutoGen 的对话机制导致 Token 消耗高。每次 Agent 之间的消息传递都会占用上下文窗口。LangGraph 的状态驱动模式更高效——状态只存储必要信息,不会无限膨胀。

3.3 选型决策框架

如果你在纠结选哪个,可以这样判断:

选 CrewAI,如果:

- 快速做原型,演示效果

- 团队对 Agent 开发经验有限

- 任务流程相对固定,不需要复杂的条件分支

- 项目周期短,优先交付

选 LangGraph,如果:

- 构建生产级系统

- 需要精确控制流程和状态

- 有复杂的条件分支、并行执行需求

- 长期维护、迭代

选 AutoGen,如果:

- 任务需要多 Agent 协商、讨论

- 有现成的 LLM 配额,Token 消耗不是问题

- 研究性质的项目,探索 Agent 协作模式

我的建议:如果你不确定,先从 LangGraph 学起。它的概念更底层,学会了之后理解 CrewAI 和 AutoGen 会更容易。而且 LangGraph 的文档和社区支持是目前三者中最好的。

Observability 与生产部署实战

Agent 上生产后,你会面临一个新问题:它跑起来是个黑盒。你不知道它在哪个节点卡住了、为什么输出了奇怪的结果、Token 消耗是不是正常。Observability 工具就是为了解决这些问题。

4.1 LangSmith 集成

LangSmith 是 LangChain 官方的 Observability 平台。它能追踪每一次调用、可视化 Agent 的执行路径、评估输出质量。

import os

# 配置环境变量(启动时设置一次即可)

os.environ["LANGSMITH_API_KEY"] = "your-api-key"

os.environ["LANGSMITH_TRACING"] = "true"

os.environ["LANGSMITH_PROJECT"] = "my-agent-project"

# 之后的每次 invoke 都会自动上报

result = app.invoke({"messages": [...]})

# 在 LangSmith 控制台查看:

# - 完整的调用链路

# - 每个节点的输入输出

# - Token 消耗明细

# - 执行时间分布LangSmith 的 trace 功能是我调试 Agent 时最常用的。有次用户反馈 Agent 偶尔会输出无关内容,我在 LangSmith 里翻 trace 记录,发现某个检索节点返回了错误的结果。问题定位花了不到 10 分钟,修起来也快——加了个过滤条件就解决了。

成本方面,LangSmith 有免费额度(每月 5000 次 trace),小项目够用。团队版 $39/月起,适合多人协作。

4.2 Langfuse 开源替代

如果你的项目对数据隐私敏感,或者想自己掌控 Observability 数据,Langfuse 是个开源替代方案。

# 安装

# pip install langfuse

from langfuse.langchain import CallbackHandler

# 初始化 handler

langfuse_handler = CallbackHandler(

public_key="pk-xxx",

secret_key="sk-xxx",

host="https://cloud.langfuse.com" # 或自托管地址

)

# 注入到 invoke

result = app.invoke(

{"messages": [...]},

config={"callbacks": [langfuse_handler]}

)

# Langfuse 会记录:

# - prompt 和 completion

# - 模型参数

# - Token 使用量

# - 执行时间Langfuse 支持自托管,可以用 Docker 一键部署。它的功能比 LangSmith 少一些,但核心的 trace、评分、数据集管理都有。我有个项目因为合规要求不能把数据传到第三方,就用 Langfuse 自托管版,跑在私有 Kubernetes 集群里。

功能对比:

| 功能 | LangSmith | Langfuse |

|---|---|---|

| Trace 追踪 | 支持 | 支持 |

| 可视化 | 强 | 中等 |

| 自托管 | 不支持 | 支持 |

| 价格 | $0-$39+/月 | 开源免费 |

| 数据集管理 | 支持 | 支持 |

| 评分系统 | 支持 | 支持 |

4.3 自定义 Metrics

除了用现成的 Observability 平台,你也可以自己埋点收集指标。

状态转换追踪:记录每个节点的进入/退出时间,计算耗时分布。

import time

from datetime import datetime

# 自定义节点包装器

def timed_node(node_func):

def wrapper(state):

start = time.time()

print(f"[{datetime.now()}] Entering {node_func.__name__}")

result = node_func(state)

elapsed = time.time() - start

print(f"[{datetime.now()}] Exiting {node_func.__name__}, took {elapsed:.2f}s")

return result

return wrapper

# 使用

@timed_node

def my_research_node(state):

# 节点逻辑

return state决策路径可视化:记录 Agent 经过的节点序列,分析常见路径。

# 在状态中添加路径字段

class TrackedState(MessagesState):

visited_nodes: list = []

# 每个节点执行后追加记录

def track_visit(state, node_name):

state["visited_nodes"].append({

"node": node_name,

"timestamp": datetime.now().isoformat()

})

return state这些自定义 metrics 可以上报到你自己的监控系统(Prometheus、Grafana),和业务指标一起分析。我曾经发现某个 Agent 在晚高峰时段响应变慢,通过自定义 metrics 定位到是外部 API 调用超时。加了重试机制和熔断后,p99 延时从 15 秒降到了 3 秒。

2026 Agent 工程趋势与 LangGraph 演进

技术变化很快,但有些趋势值得提前了解。

5.1 LangChain State of Agent Engineering 报告核心发现

LangChain 在 2026 年初发布了 State of Agent Engineering 报告,基于对数百个生产级 Agent 系统的分析。三个发现让我印象深刻:

发现一:图架构成为主流

超过 70% 的生产 Agent 采用了某种形式的图结构(DAG 或状态机),而不是简单的线性 Chain。原因很现实:真实的业务流程很少是一条直线走到黑。用户可能随时打断、要求澄清、切换话题——图结构能更好地处理这些复杂情况。

发现二:Human-in-the-loop 标准化

60% 的 Agent 系统加入了人工干预点。不再是 Agent 全自动跑完,而是在关键决策点暂停、等待人类确认后继续。LangGraph 的 interrupt API 就是为此设计的:

# 在关键节点暂停,等待人工审核

graph.add_node("human_review", interrupt=True)

# 审核通过后继续

app.update_state(config, {"approved": True})

result = app.invoke(None, config) # 从中断点继续执行这个模式在金融、医疗等高风险场景特别重要——你不能让 Agent 自动执行转账或开处方,得有人类把关。

发现三:Observability 工具成熟

报告里提到一个数据:配备 Observability 工具的 Agent,平均故障排查时间比没有工具的短 60%。这和我自己的经验一致——没有 trace,调试 Agent 就像在黑暗中摸索。

5.2 LangGraph 2026 新特性

LangGraph 在 2026 年有几个重要更新:

Pydantic v3 状态定义成为标准

Pydantic v3 的性能比 v2 提升了 5-10 倍,验证速度更快。LangGraph 官方推荐所有新项目使用 Pydantic BaseModel 定义状态。

Subgraph 模块化

你可以把复杂的 Agent 拆成多个 Subgraph,每个 Subgraph 是一个独立的状态机,可以单独测试、复用。

# 子图:独立的检索 Agent

research_subgraph = StateGraph(ResearchState)

research_subgraph.add_node("search", search_node)

research_subgraph.add_node("summarize", summarize_node)

research_subgraph.compile()

# 主图:调用子图

main_graph = StateGraph(MainState)

main_graph.add_node("research", research_subgraph)

main_graph.add_node("write", write_node)这个特性对大型项目很有用——不同团队可以各自开发 Subgraph,最后组装起来。

Deep Agents:规划 + 子代理 + 文件系统

LangGraph 引入了 “Deep Agents” 概念:一个主 Agent 负责规划,调用多个子代理执行具体任务,还能操作文件系统。这让 Agent 能处理更复杂的工作流,比如”分析这个 PDF,生成报告,保存到指定目录”。

5.3 未来展望

Agent Governance 演进

随着 Agent 在生产环境的应用,治理问题会越来越重要:Agent 谁来监管?决策出错怎么追责?合规性怎么保证?LangChain 已经在推 AgentOps 的概念,类似 DevOps,但针对 Agent 的全生命周期管理。

多模态 Agent 支持

现在的 Agent 主要处理文本。未来会更多结合图像、音频、视频。LangGraph 已经在支持多模态消息类型,但完整的跨模态工作流还在探索中。

我不确定这些预测会不会全部成真,但有一点是确定的:Agent 工程还处于早期阶段,最佳实践每天都在演进。保持学习,多看官方文档和社区讨论,是跟上变化的唯一办法。

总结

这篇文章覆盖了 LangGraph 状态管理的几个核心维度:

- StateGraph 构建:图结构 + 状态驱动是 Agent 开发的基础范式

- Reducer 模式:并行执行时状态合并的关键机制

- 持久化选型:MemorySaver 开发用,PostgresSaver 上生产

- 框架对比:LangGraph 控制力最强,CrewAI 上手最快,AutoGen 适合协作场景

- Observability:LangSmith 或 Langfuse,二选一,必须有

几点行动建议:

- 检查你现有的 Agent 项目。如果还在用 MemorySaver,立刻规划迁移到 PostgresSaver。

- 读一遍 LangChain 的 State of Agent Engineering 报告,了解行业趋势。

- 给你的 Agent 加上 Observability——不管是 LangSmith 还是自托管 Langfuse,先跑起来。

- 如果你刚入门 Agent 开发,参考本系列的 Agent 记忆系统设计和 AI Agent 架构设计,构建完整的技术栈。

Agent 工程还在快速演进,今天的最佳实践可能明年就过时。但掌握基础原理——状态管理、持久化、可观测性——能让你更好地理解和应用新工具。

常见问题

LangGraph 的 StateGraph 和普通 Graph 有什么区别?

什么时候需要用自定义 Reducer 函数?

生产环境应该选哪种 Checkpointer?

LangGraph、CrewAI、AutoGen 选哪个框架?

• LangGraph:生产级系统,需要精确控制流程和状态

• CrewAI:快速原型,团队经验有限,项目周期短

• AutoGen:多 Agent 协商讨论场景,研究性项目

Observability 工具选 LangSmith 还是 Langfuse?

16 分钟阅读 · 发布于: 2026年4月24日 · 修改于: 2026年4月25日

相关文章

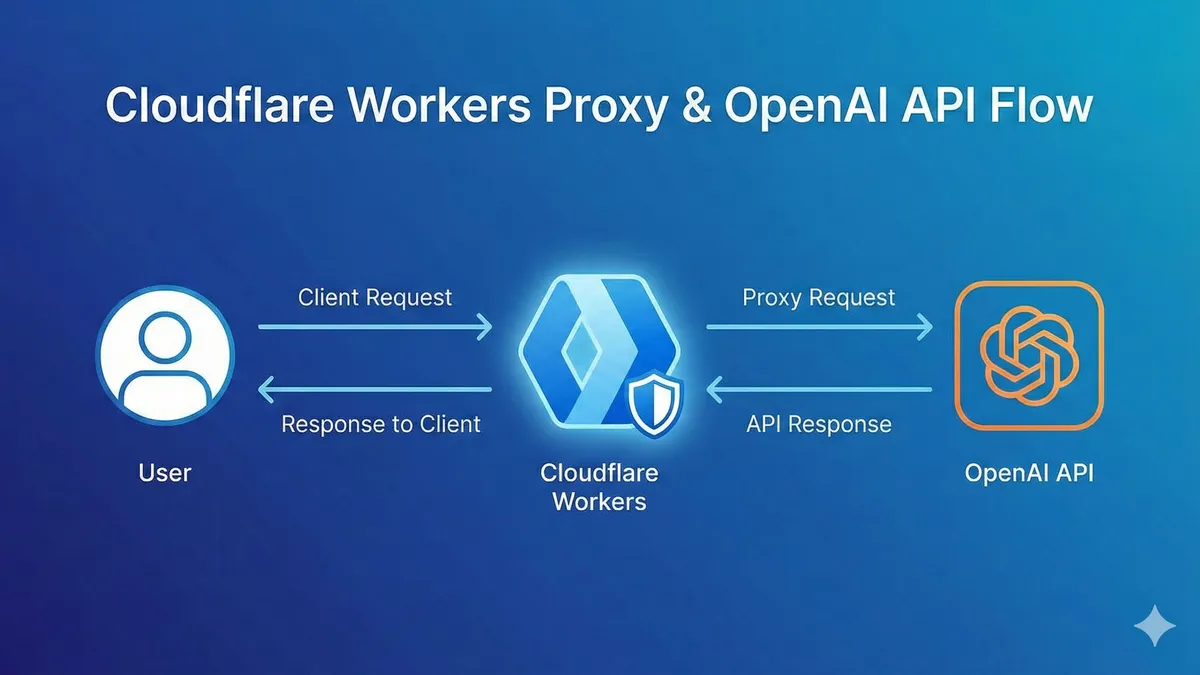

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

AI重构10000行老代码:2周完成1个月工作量的真实复盘

AI重构10000行老代码:2周完成1个月工作量的真实复盘

OpenAI接口总是超时?用Workers搭建私人通道,0成本更稳定

评论

使用 GitHub 账号登录后即可评论