LLM 评估框架对比:LangSmith vs W&B vs MLflow

你的 LangChain 应用上线了,用户反馈说”有时候回答很奇怪”。你打开日志,只看到一堆 JSON,根本不知道是哪一步出了问题——是 Prompt 设计有问题?是 RAG 检索召回率低?还是 Agent 工具调用失败了?

凌晨两点,盯着第 37 次调试输出,你突然意识到:LLM 应用和传统软件不一样,它的输出是不确定的,执行链路可能长达 10 到 100 步。光看日志根本不够,你需要一个能追踪每一步、评估每一次调用的工具。

问题来了:LangSmith、Weights & Biases、MLflow,三个工具都在说自己是”LLM 可观测性解决方案”,该选哪一个?价格差这么多,功能到底有什么区别?

这篇文章给你答案。读完之后,你会清楚知道:

- 三个工具的核心定位和功能差异

- 哪个适合你的团队规模和预算

- 如何根据技术栈做出选择

- 真实的成本——不只是定价表上的数字

LangSmith、W&B、MLflow:定位决定了你的选择

说实话,这三个工具的根本差异不在功能列表上——而在它们的”出身”和”基因”。理解这一点,比逐条对比功能重要得多。

LangSmith:LangChain 生态的原生监控平台

LangSmith 是 LangChain 公司亲生的,跟 LangChain、LangGraph 是一个妈生的。什么意思?如果你用 LangChain 开发 LLM 应用,LangSmith 几乎是零配置集成——安装 SDK,加两行代码,完事。

我去年在一个 Agent 项目里用过。那会儿我们用 LangGraph 做状态管理,Agent 执行链路复杂得要命,一个请求可能调用七八个工具,中间还有条件分支。用 LangSmith 的 tracing 功能,整个执行图谱清清楚楚:哪一步卡住了,哪个工具返回了错误结果,一目了然。

LangSmith 的核心功能包括:

- Dataset-based evaluations:上传测试数据集,自动跑评估

- LLM-as-Judge:用 GPT-4 等 LLM 来评判输出质量

- Tracing:追踪每一步 LLM 调用、工具调用、Chain 执行

- Playground:在线调试 Prompt,实时看效果

一句话总结:如果你用 LangChain 或 LangGraph,LangSmith 是最省心的选择。不用折腾集成,不用研究文档,直接用。

Weights & Biases:ML 实验追踪的老牌选手

Weights & Biases(简称 W&B)比 LangSmith 老多了。它从 2018 年就开始做机器学习实验追踪,主要面向研究和实验场景。你做超参数调优、对比几十个模型的性能、记录训练曲线——这些是它的强项。

2024 年,W&B 推出了 Weave,专门支持 LLM 应用追踪。Weave 能追踪 LLM 调用链路、计算 Token 成本、对比不同 Prompt 的输出效果。

但说实话,我总觉得 W&B 有点”穿新鞋走老路”的感觉。它的 LLM 功能是后来加的,界面上能看出传统 ML 实验管理的痕迹——比如实验对比表格、训练曲线图表。这些对于研究场景很棒,但对于生产环境的 LLM 监控,体验不如 LangSmith 丝滑。

W&B 的核心功能:

- Weave LLM Tracing:追踪 LLM 调用链路

- 实验对比:横向对比几十个实验的参数和结果

- 成本估算:计算 Token 消耗和 API 成本

- 团队协作:实验记录、注释、分享

一句话总结:如果你要做大量实验对比和超参数调优,W&B 是老牌工具。但生产监控体验不如 LangSmith。

MLflow:开源 MLOps 的灵活选择

MLflow 是 2018 年由 Databricks 开源的,定位是”开源的机器学习生命周期管理平台”。它包括四个模块:实验追踪、模型注册、模型部署、项目打包。

MLflow 的核心定位是:你需要完全控制、不想被厂商锁定。它开源免费,你可以自己部署在任何服务器上,数据完全掌握在自己手里。

但 MLflow 的 LLM 支持相对较弱。它有 mlflow.evaluate() 接口,内置了 50+ 评估指标,但主要面向传统 ML 模型。LLM 特有的能力——比如多轮对话评估、Agent 执行追踪——不如 LangSmith 和 W&B 完善。

我有个朋友在金融公司做 LLM 项目,合规要求严格,数据不能出内网。他们选了 MLflow,自己搭建在机房里,数据完全自控。代价是运维成本高——需要自己维护服务器、数据库、存储,还要处理升级和备份。

MLflow 的核心功能:

- 实验追踪:记录参数、指标、模型文件

- 模型注册:版本管理、模型打包

- 模型部署:支持多种部署方式

- 50+ 内置评估指标:传统 ML + 部分 LLM 指标

一句话总结:如果你需要开源和完全控制,MLflow 免费,但 LLM 能力较弱,需要自己补齐短板。

不只是追踪:评估、调试、部署能力对比

光看定位还不够,你得知道具体干活的时候,谁更顺手。我从三个维度对比:追踪能力、评估能力、生产部署能力。

追踪能力:谁能把执行链路讲清楚

LLM 应用最头疼的就是执行链路长。一个 Agent 调用可能涉及:Prompt 构建 → LLM 调用 → 工具执行 → 结果解析 → 再次 LLM 调用。中间哪一步出问题,都可能影响最终输出。

| 维度 | LangSmith | W&B Weave | MLflow |

|---|---|---|---|

| LLM-native Tracing | ✅ 原生支持,专为 LLM 设计 | ✅ 支持,但偏向传统实验 | ⚠️ 通用追踪,LLM 支持弱 |

| Agent 执行图 | ✅ 可视化展示整个 Agent 流程 | ⚠️ 支持基础追踪,图形化较弱 | ❌ 不支持 |

| 多轮对话追踪 | ✅ 完整记录每轮对话 | ✅ 支持 | ⚠️ 需自定义 |

| 工具调用追踪 | ✅ 自动记录每个工具调用 | ✅ 支持 | ❌ 不支持 |

| 执行时间分析 | ✅ 每一步耗时统计 | ✅ 支持 | ✅ 支持 |

说白了,LangSmith 在追踪这块是专业选手——它专门为 LLM 应用设计,Agent 执行图、工具调用追踪这些,原生支持。W&B Weave 也能追踪,但体验更像是”给传统实验管理加了个 LLM 模块”。MLflow 就更弱了,它主要面向传统 ML,LLM 的特殊需求基本要自己写代码适配。

举个例子。去年我调试一个 RAG Agent,检索结果有时候很离谱。用 LangSmith 的 tracing,我看到问题出在 Embedding 模型——某个查询的向量距离计算错误,导致召回的文档完全不对。这要是用日志文件排查,得翻几百行 JSON,根本看不出来。

评估能力:谁能帮你判断输出好不好

追踪是”知道发生了什么”,评估是”知道结果好不好”。LLM 输出的不确定性,让评估变得特别重要。

| 维度 | LangSmith | W&B Weave | MLflow |

|---|---|---|---|

| LLM-as-Judge | ✅ 原生支持,多模型可选 | ⚠️ 需配置 | ⚠️ 需自定义 |

| Dataset Management | ✅ 上传数据集,批量评估 | ✅ 支持 | ✅ 支持 |

| 多轮对话评估 | ✅ 专门针对对话场景 | ⚠️ 需自定义 | ❌ 不支持 |

| 输出对比 | ✅ 多版本输出对比 | ✅ 强项,横向对比 | ⚠️ 需手动配置 |

| 内置评估指标 | 10+ LLM 专用指标 | 5-10 LLM 相关指标 | 50+ 传统 ML 指标 |

LangSmith 的 LLM-as-Judge 很好用——你可以用 GPT-4 或 Claude 来评判你的模型输出质量。比如”回答是否准确”、“是否有害”、“是否简洁”。这些评判标准可以自定义,还能保存成模板复用。

W&B 的输出对比是强项。如果你要对比 20 个不同 Prompt 的效果,W&B 的表格视图非常直观:横着看每个 Prompt 的输出,竖着看评估指标。这是 W&B 从传统 ML 实验管理继承的优势。

MLflow 内置指标最多——50+ 个。但这些指标主要面向传统 ML 模型(准确率、F1、AUC 等)。LLM 专用的指标(比如语义相似度、有害性检测)需要自己写代码实现。

生产部署能力:谁能陪你上线运营

研究阶段和上线运营,需求不一样。研究阶段重点是”实验对比”,上线运营重点是”监控告警”。

| 维度 | LangSmith | W&B Weave | MLflow |

|---|---|---|---|

| 监控告警 | ✅ 支持错误率、延迟告警 | ⚠️ 主要面向实验,生产监控弱 | ⚠️ 需配合 Grafana |

| A/B 测试 | ✅ 支持不同版本对比 | ⚠️ 实验对比,不是生产 A/B | ❌ 不支持 |

| 集成难度 | ✅ LangChain 零配置 | ⚠️ 需手动集成 | ⚠️ 需自己部署 |

| 生产稳定性 | ✅ 云服务,高可用 | ✅ 云服务 | ⚠️ 自己运维 |

LangSmith 在生产部署这块体验最好。它是云服务,不用担心服务器宕机、数据备份。监控告警、A/B 测试、错误追踪,一套流程下来很顺畅。

W&B 主要面向研究阶段。它的实验对比功能很棒,但生产监控——比如实时告警、错误追踪——不如 LangSmith 完善。

MLflow 需要你自己运维。这意味着你得搞定服务器、数据库、备份、升级。好处是完全自主控制,坏处是运维成本高。生产环境可以用 MLflow + Grafana 组合:MLflow 记录实验,Grafana 做监控告警。

定价只是表面,真实 TCO 才是决策关键

很多人看定价表,觉得 MLflow 免费,LangSmith 收费,就选 MLflow。这想法太简单了。真实成本(TCO)不只是定价表上的数字,还包括运维人力、集成成本、机会成本。

定价对比表

| 工具 | 价格模型 | 免费额度 | 典型月成本(5人团队) |

|---|---|---|---|

| LangSmith | 按 Seat + Traces | 5,000 traces/月免费 | Plus 版:$39/seat,小团队约 $120-200/月 |

| W&B | 多层定价:Free/Team/Enterprise | 个人免费,团队付费 | Team 版约 $50/seat,中团队 $500+/月 |

| MLflow | 完全开源免费 | 无限制 | 基础设施成本:$100-300/月(服务器 + 存储) |

LangSmith 的定价相对清晰。免费版每月 5,000 traces,够个人开发者用。Plus 版 $39 每个席位,如果 5 人团队,月成本约 $120-200(取决于 traces 用量)。Enterprise 版需要联系销售,价格自定义。

W&B 的定价比较复杂。个人版免费,Team 版大约 $50/seat,Enterprise 版价格要谈。而且 W&B 的计费不只是 seat,还包括实验存储量、数据存储量等。中等规模团队(10-20 人)月成本很容易超过 $500。

MLflow 表面免费,但你得自己部署。服务器、数据库、存储、带宽——这些都要钱。简单估算:一台云服务器(2核4G)月费 $50-100,存储(100GB)$20-50,带宽流量 $30-50。合计 $100-200/月。如果需要高可用(多台服务器 + 负载均衡),成本翻倍。

隐藏成本:你没想到的部分

光看定价表,你可能觉得 MLflow 最省钱。但还有几个隐藏成本:

MLflow 的运维成本:服务器要维护,软件要升级,备份要做,故障要排查。这些都需要人力。如果你的团队没有专门的运维工程师,开发者得花时间折腾 MLflow。时间也是成本——一个开发者月薪 20K,每周花 4 小时维护 MLflow,月成本约 2K。这还没算故障排查的时间。

商业工具超出免费额度后的边际成本:LangSmith 5,000 traces 免费,但如果你的应用每天调用 500 次 LLM,一个月就是 15,000 traces,超出免费额度。Plus 版按 traces 计费,超出部分有额外成本。这个要提前估算。

集成成本:LangSmith 集成 LangChain 很简单,但如果你的技术栈是 LlamaIndex 或者纯 Python 调用 OpenAI API,集成难度会增加。W&B 和 MLflow 的集成都需要写代码,不是零配置。

真实成本计算示例

假设一个 5 人团队,月 10,000 traces:

| 工具 | 定价成本 | 运维成本 | 集成成本(一次性) | 月真实成本 |

|---|---|---|---|---|

| LangSmith Plus | $200 | $0(云服务) | $0(零配置) | $200 |

| W&B Team | $250 | $0(云服务) | $500(2天集成) | $250 + 一次性$500 |

| MLflow 自建 | $0 | $150(服务器) + $400(运维人力) | $1,000(3天集成部署) | $550 + 一次性$1,000 |

这么算下来,MLflow 不一定省钱。如果你的团队运维能力强、有现成的基础设施,MLflow 可以省钱。但如果你的团队专注于开发,不想花时间折腾运维,商业工具(LangSmith 或 W&B)可能更划算。

关键问题:你的团队时间值多少钱?。开发者花一周部署 MLflow,能不能换来其他价值?如果答案是”不值得”,就别纠结免费了——付费工具可能是更好的选择。

根据你的情况,这样选

说了这么多,到底选哪个?我给你一个决策流程,按顺序判断:

决策流程

第一步:你是否使用 LangChain 或 LangGraph?

- Yes → 直接选 LangSmith。零配置集成,省心省力。

- No → 继续第二步。

第二步:你是否需要完全开源 / 无厂商锁定?

- Yes → 选 MLflow + Langfuse 组合。MLflow 做实验追踪,Langfuse 做生产监控。两者都是开源,数据完全自主。

- No → 继续第三步。

第三步:你的主要工作场景是什么?

- 研究阶段,大量实验对比 → 选 W&B Weave。它的实验对比功能是强项,超参数调优也很顺手。

- 生产环境,需要监控告警 → 选 LangSmith 或 Langfuse。LangSmith 云服务,Langfuse 开源可自建。

第四步:团队规模和预算?

- 小团队(under 5 人),预算有限 → LangSmith 免费版(5,000 traces 够用)或 MLflow 自建。

- 中团队(5-20 人),有一定预算 → LangSmith Plus 或 W&B Teams,月成本 $200-500。

- 大团队(over 20 人),预算充足 → Enterprise 版(LangSmith 或 W&B),或者自建高可用 MLflow + Grafana 组合。

推荐组合总结

| 场景 | 推荐组合 | 原因 |

|---|---|---|

| LangChain 用户 | LangSmith | 零配置,原生集成,最省心 |

| 研究实验为主 | W&B Weave | 实验对比强项,超参数调优顺手 |

| 需要开源控制 | MLflow + Langfuse | 数据自主,成本可控,LLM 能力补齐 |

| 小团队预算有限 | LangSmith 免费版 | 5,000 traces 够用,先试后付费 |

| 大企业合规要求 | MLflow 自建 + Grafana | 数据不出内网,完全自主控制 |

说实话,没有”完美工具”。每个工具都有取舍:LangSmith 方便但付费,MLflow 免费但要折腾,W&B 研究强但生产弱。关键是根据你的技术栈、预算、团队情况做出选择——而不是看别人用什么就跟着选。

结论

LLM 应用的监控和评估不是”锦上添花”,而是”生产必备”。没有监控,你根本不知道应用在线上发生了什么;没有评估,你无法判断输出质量是否达标。

LangSmith、W&B、MLflow 各有取舍,关键看你的技术栈、预算和需求:

- LangSmith 是 LangChain 用户的首选——零配置、深度集成、功能完整。如果你用 LangChain 或 LangGraph,选它。

- MLflow + Langfuse 是需要开源和完全控制的团队的选择——免费、自主,但要花时间运维。

- W&B Weave 适合大量实验对比和超参数调优的研究场景——传统优势依然存在,但生产监控体验不如 LangSmith。

最后给一个建议:不要只看定价表,要看真实 TCO。MLflow 免费,但需要运维成本;LangSmith 付费,但节省开发和调试时间。选工具不只是选功能,更是选 ROI——你的团队时间值多少钱?这个问题比”哪个工具更便宜”更重要。

你现在用的是什么工具?遇到什么问题?欢迎在评论区分享你的选型经验。

常见问题

LangSmith 免费版的 5,000 traces 够用吗?

MLflow 自建的运维成本大概多少?

不用 LangChain 能用 LangSmith 吗?

W&B Weave 和 LangSmith 的 LLM 追踪有什么区别?

生产环境推荐用哪个?

如何从现有的监控方案迁移?

16 分钟阅读 · 发布于: 2026年4月28日 · 修改于: 2026年4月28日

相关文章

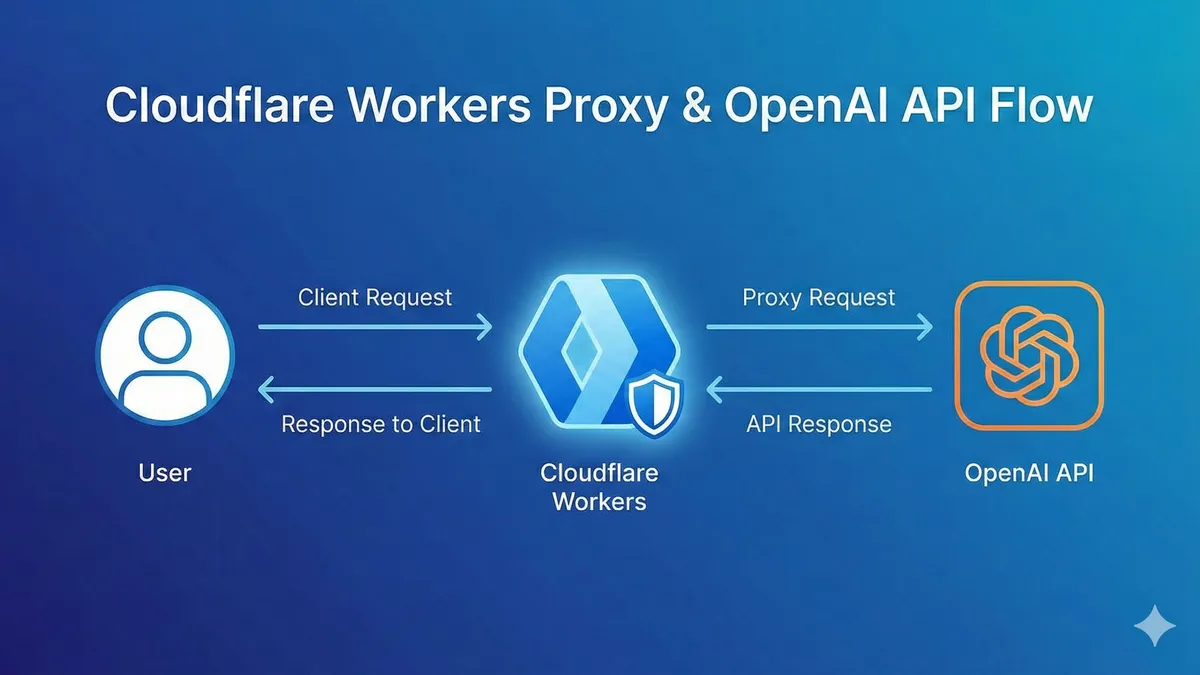

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

AI重构10000行老代码:2周完成1个月工作量的真实复盘

AI重构10000行老代码:2周完成1个月工作量的真实复盘

OpenAI接口总是超时?用Workers搭建私人通道,0成本更稳定

评论

使用 GitHub 账号登录后即可评论