RAG 向量数据库选型实战:Pinecone vs Weaviate vs Milvus 深度对比

凌晨三点,我盯着服务器监控面板上那条不断攀升的红色曲线——P99 延迟已经飙到 800ms,而我们的 RAG 系统只有 200 万条文档。说实话,当时脑子一片空白。

这是个典型的选型失误案例。我们团队最初用 Chroma 快速搭建原型,两周搞定,一切看起来都很美好。但数据量突破百万后,查询延迟从 20ms 一路飙升,用户体验直接崩了。迁移到其他方案又花了整整三周——数据导出、向量重建、索引配置,每一步都在踩坑。

选对向量数据库,你的 RAG 系统就成功了一半。这话不是我瞎说的,是我们在实战中用泪换来的教训。检索环节决定 AI 能不能找到”对的”信息,生成环节才能在此基础上给出”好的”回答。检索垮了,后面再怎么调 Prompt、改模型都是白费力气。

这篇文章,我会把 Pinecone、Weaviate、Milvus 三款主流向量数据库的真实对比数据摊开来讲——性能基准、定价模型、适用场景,还有我和团队踩过的坑。读完你会有一个清晰的选型决策框架,知道自己的场景该选什么,也能算出真实的成本预算。

第一章:为什么向量数据库选型如此重要?

1.1 向量数据库在 RAG 系统中的角色定位

很多人有个误解:向量数据库就是存 Embedding 的”仓库”。其实,它的核心价值不在于存储,而是高效检索”语义相似性”。

传统数据库擅长精确匹配——比如 WHERE id = 100。但 RAG 系统要解决的是另一类问题:用户问”如何优化 Python 代码性能”,你需要找到语义上最相关的文档,而不是精确匹配某个关键词。向量数据库把文本、图片、音频转换成高维向量(比如 OpenAI 的 text-embedding-3-small 生成 1536 维向量),然后用 ANN(近似最近邻)算法在百万甚至亿级向量中快速找到”距离最近”的候选。

ANN 算法的核心权衡:召回率 vs 查询延迟。精确计算所有向量距离成本极高——100 万个 1536 维向量,全量扫描一次要几十秒。ANN 算法(HNSW、IVF、PQ)通过”近似”把延迟压到毫秒级,代价是可能漏掉一些相关结果。不同向量数据库在”召回率-延迟”曲线上的取舍策略不同,这直接影响 RAG 系统的检索精度。

1.2 选型失误的真实代价

我们团队的踩坑经历算是个典型样本。Chroma 本地开发确实好用——pip install chromadb,五分钟就能跑起来。但当文档量超过 100 万条,单机部署的瓶颈就暴露了:跨机器扩展需要自己管服务器,数据迁移、索引重建、负载均衡全得手动搞。

还有一个更隐蔽的坑:Pinecone 的成本失控。它的免费层支持 100 万向量,看着挺美好。但你一旦上了付费层,按存储量和查询次数双重计费的模式会让人措手不及。有个做法律 AI 的朋友,5000 万文档、每天 10 万查询,月账单飙到 $3000+——远超他们最初预估的 $500 预算。

选型失误不只是技术问题,更是钱的问题。

1.3 2026 年向量数据库格局

现在市面上基本是”三强争霸 + 新势力崛起”:

三大主力:

- Pinecone:全托管 Serverless,开箱即用,适合快速启动。2026 年推出 Serverless 方案后,启动门槛进一步降低。

- Weaviate:模块化设计,内置图数据库能力,混合搜索(关键词+向量)表现突出。

- Milvus:分布式云原生架构,GPU 加速,亿级向量毫秒级响应,适合大规模场景。

新势力:

- pgvector:PostgreSQL 扩展,如果你本来就用 PG,零额外成本就能接入向量检索。适合轻量级、数据量不大的场景。

- Qdrant:开源、性能不错,性价比定位,自托管场景下比 Milvus 更轻量。

这篇文章重点对比前三款,因为它们覆盖了从”零运维托管”到”大规模自托管”的主流需求。pgvector 和 Qdrant 我会在特殊场景部分提一下。

第二章:三款数据库的核心差异对比

2.1 架构设计:三种不同的思路

Milvus:分布式云原生架构

Milvus 的设计哲学是”为大规模而生”。它天生就是分布式架构——支持 Kubernetes 部署、多副本同步、水平扩展。核心组件拆得很清晰:协调节点管调度、数据节点管存储、查询节点管检索,各司其职。

实际部署 Milvus 需要专业运维能力。你得懂 Kubernetes、懂集群配置、懂 GPU 加速参数调优。好处是:一旦跑起来,从 1000 万到 10 亿向量,加节点就能扩展,不用换架构。Milvus 官方文档给的建议配置:生产环境至少 3 节点集群,单节点 16GB 内存起步,亿级数据需要 GPU 加速(NVIDIA A100 或同级)。

Pinecone:全托管 Serverless

Pinecone 把”省心”做到极致。你不需要管服务器、不需要配置索引、不需要操心扩缩容——注册账号、创建索引、调用 API,三步搞定。2026 年的 Serverless 方案更是把启动成本压到最低:按实际使用计费,空闲时几乎不花钱。

但便利的背后是灵活性受限。Pinecone 只提供垂直扩展——索引容量上限由云服务商控制,你不能像 Milvus 那样加节点横向扩展。自定义索引参数(比如 HNSW 的 M、ef 参数)也有限,只能选预置的几种配置。如果你的场景需要深度调优检索性能,Pinecone 可能让你觉得”被绑住了”。

Weaviate:模块化设计 + 图数据库基因

Weaviate 的架构有点特别:它把向量数据库和图数据库融合在一起。每个向量可以带上”对象”属性(文本、图片、元数据),还能定义对象之间的语义关系。这对知识图谱类场景特别友好——不只是找相似向量,还能顺着关系链检索。

模块化是 Weaviate 另一个亮点。Embedding 模块可以接 OpenAI、Cohere、本地模型;向量化模块可以自定义;多模态检索(文本搜图片)有现成支持。部署方式灵活:自托管、云托管(Weaviate Cloud)、Hybrid 模式都行。但灵活也意味着配置项多,上手门槛比 Pinecone 高一些。

2.2 性能基准:真实数据对比

下面这张表的数据来自腾讯云 2025 年的对比评测,以及 IoT Digital Twin PLM 2026 年的基准测试报告。测试条件:1536 维向量(OpenAI text-embedding-3-small)、HNSW 索引、召回率 95%。

| 产品 | 单索引容量 | 延迟(P99) | 混合检索 | 分布式支持 | GPU加速 |

|---|---|---|---|---|---|

| Milvus | 百亿级 | <50ms | 支持 | 支持 | 支持 |

| Weaviate | 千亿级 | <150ms | 支持 | 支持 | 不支持 |

| Pinecone | 十亿级 | <100ms | 支持 | 自动扩缩容 | 不支持 |

几个关键观察:

-

延迟差距明显:Milvus GPU 加速后 P99 延迟压到 50ms 以内,比 Weaviate 快 3 倍。如果你的场景对响应速度敏感(比如实时问答、客服对话),这个差距用户能感知到。

-

容量上限不同:Weaviate 官称支持千亿级向量,但实际测试中超过 10 亿后性能衰减明显。Milvus 在亿级规模表现稳定,得益于分布式架构和数据分片策略。Pinecone 十亿级上限对中小规模场景够用,但大规模企业级场景可能受限。

-

混合检索成为标配:三款都支持向量+关键词混合检索。Weaviate 在这方面表现突出——它的图数据库基因让语义关系建模更自然,检索准确率在”复杂语义”场景下比纯向量搜索高 5-10%(腾讯云评测数据)。

2.3 定价模型:算清楚真实成本

定价这块,各家玩法不一样。我整理了主要方案的成本构成:

Pinecone 定价:

- 免费层:100 万向量,$0 存储成本,有限查询次数

- 付费层:$70/月起(含 10 亿向量存储),超出部分按查询计费

- 计费公式:

Cost = $70 + (查询数 × $0.0001/次)(超出免费额度后)

Weaviate 定价:

- 云托管:$0.01/GB/月(存储),查询次数不限

- 计费公式:

Cost = (向量数 × 1536维 × 4字节 ÷ 1GB) × $0.01 × 月数 - 自托管:开源免费,自己承担服务器成本

Milvus 定价:

- 开源版:自托管免费

- 云托管(腾讯云/AWS):按节点计费,高配节点约 $2000/月

- 计费公式:

Cost = 节点数 × $2000/月 + GPU成本(如果需要)

给你一个实际计算案例:5000 万向量、每天 10 万查询、1536 维。

| 方案 | 月成本估算 | 说明 |

|---|---|---|

| Pinecone付费 | $70 + 10万×30×$0.0001 = $370 | 按查询计费,查询多时成本高 |

| Weaviate云托管 | 5000万×1536×4÷1024³ × $0.01 ≈ $3 | 存储计费,查询不限,超便宜 |

| Milvus自托管 | 服务器$500 + GPU$1000 = $1500 | 长期使用摊薄成本,但运维人力成本另算 |

这里有个要点:Weaviate 按存储计费的模式在”高频查询”场景下性价比极高。但要注意,自托管方案的运维成本很多人没算进去——招聘一个懂 Kubernetes 的运维,年薪至少 $50k。

第三章:不同场景的选型决策树

选型这事没有”最好”,只有”最适合”。我按数据量和团队规模给你一个决策框架。

3.1 快速原型验证(<100 万向量)

推荐方案:Pinecone 免费层 或 Chroma 本地部署

如果你在做产品原型验证、内部 Demo、或者不确定数据增长速度,优先选 Pinecone 免费层。理由很简单:零运维、5 分钟集成、免费额度够用。Chroma 也可以,但要注意——一旦数据量突破百万,迁移会很痛苦。

代码启动速度对比:

Pinecone:

from pinecone import Pinecone

pc = Pinecone(api_key="your-api-key")

index = pc.Index("my-index") # 索引已在云端创建好Chroma:

import chromadb

client = chromadb.Client() # 本地内存模式

collection = client.create_collection("my-collection")两者启动都很快,但 Pinecone 的索引在云端持久化,Chroma 本地模式下重启进程数据就丢了。如果原型需要跨会话持久化,Pinecone 免费层更合适。

3.2 生产级中小规模(100 万-1 亿向量)

推荐方案:Pinecone 付费层 或 Weaviate 云托管

这个阶段选型要考虑两个因素:运维成本和检索准确率。

如果团队没有专职运维,优先选托管服务。Pinecone 和 Weaviate 云托管都能做到”免运维”。但定价模型差异很大:高频查询场景选 Weaviate(存储计费),低频查询选 Pinecone(存储+查询双重计费)。

如果你对检索准确率有高要求(比如法律 AI、医疗问答),Weaviate 的混合搜索表现更好。腾讯云评测数据显示,Weaviate 在”复杂语义”场景下准确率比纯向量搜索高 5-10%。它的图数据库能力还能做知识图谱检索——不只是找相似文档,还能顺着语义关系链找相关概念。

成本计算建议:用这个公式预估。

月成本 = (向量数 × 维度 × 4字节 ÷ 1GB) × 存储单价 × 月数

+ (日均查询数 × 30 × 查询单价)Weaviate 查询单价是 0(按存储计费),Pinecone 查询单价约 $0.0001/次。代入你的数据量算一下,差距可能很大。

3.3 大规模企业级(>1 亿向量)

推荐方案:Milvus 自托管 + Kubernetes

亿级向量场景,托管服务的性价比会崩。Pinecone 十亿级上限可能不够,Weaviate 云托管按存储计费在亿级规模下成本也很高。这时候 Milvus 自托管是最优解——开源免费、GPU 加速、水平扩展。

但前提是:你得有运维团队。部署 Milvus 需要:

- Kubernetes 集群(至少 3 节点)

- GPU 服务器(NVIDIA A100 或同级)

- 专业运维配置索引参数、调优延迟

运维人力成本别忽视。如果团队没有现成的 Kubernetes 运维能力,招聘或培训的成本要算进去。长期来看,亿级数据自托管方案的总成本比托管服务低——但前期投入大,适合数据增长确定、长期运营的项目。

3.4 特殊场景选型

多模态检索(文本搜图片、图片搜图片):Weaviate

Weaviate 内置多模态向量化模块(CLIP、多模态 Embedding 模型),一张图片可以直接上传、自动向量化、和文本向量放在同一个索引里检索。Milvus 也支持多模态,但需要自己配置向量化模块。Pinecone 目前不支持多模态——它只存储你传进去的向量,向量化逻辑你得自己搞。

知识图谱 + RAG:Weaviate

Weaviate 的图数据库基因让它能定义”对象-对象”关系。比如”公司-员工-项目”语义链,不只是找相似文档,还能顺着关系检索关联实体。Milvus 和 Pinecone 都不支持这种能力——它们只能做纯向量检索。

轻量级/已有 PostgreSQL:pgvector

如果你本来就用 PostgreSQL,数据量不大(百万级以内),pgvector 是零额外成本的方案。安装扩展 CREATE EXTENSION vector;,就能在现有数据库里存向量、做 ANN 检索。缺点是性能不如专用向量数据库,超过百万向量延迟会明显上升。

第四章:LangChain 集成实战代码

下面是三款数据库的 LangChain 集成完整示例。每个示例都包含初始化、添加向量、查询三个核心步骤,可以直接跑起来。

4.1 Pinecone + LangChain

# 安装依赖

# pip install pinecone-client langchain-openai

from pinecone import Pinecone

from langchain_openai import OpenAIEmbeddings

from langchain_pinecone import PineconeVectorStore

# 初始化 Pinecone

pc = Pinecone(api_key="your-pinecone-api-key")

index_name = "rag-demo"

# 创建索引(首次需要)

if index_name not in pc.list_indexes().names():

pc.create_index(

name=index_name,

dimension=1536, # OpenAI text-embedding-3-small

metric="cosine",

spec={"serverless": {"cloud": "aws", "region": "us-east-1"}}

)

index = pc.Index(index_name)

# 初始化 LangChain 向量存储

embeddings = OpenAIEmbeddings(model="text-embedding-3-small")

vectorstore = PineconeVectorStore(

index=index,

embedding=embeddings,

text_key="text"

)

# 添加文档

from langchain.schema import Document

docs = [

Document(page_content="Python 性能技巧:使用列表推导式替代循环", metadata={"source": "blog"}),

Document(page_content="NumPy 向量化运算比纯 Python 快 100 倍", metadata={"source": "blog"}),

]

vectorstore.add_documents(docs)

# 查询检索

results = vectorstore.similarity_search("如何 Python 性能", k=3)

for doc in results:

print(doc.page_content)4.2 Weaviate + LangChain

# 安装依赖

# pip install weaviate-client langchain-openai

import weaviate

from langchain_openai import OpenAIEmbeddings

from langchain_weaviate import WeaviateVectorStore

# 初始化 Weaviate(云托管示例)

client = weaviate.connect_to_wcs(

cluster_url="your-cluster-url.weaviate.network",

auth_credentials=weaviate.auth.AuthApiKey("your-weaviate-api-key"),

)

# 初始化 LangChain 向量存储

embeddings = OpenAIEmbeddings(model="text-embedding-3-small")

vectorstore = WeaviateVectorStore(

client=client,

index_name="RagDemo",

text_key="content",

embedding=embeddings,

)

# 添加文档

from langchain.schema import Document

docs = [

Document(page_content="RAG 系统检索精度取决于向量数据库选型", metadata={"category": "tech"}),

Document(page_content="Weaviate 混合搜索提升语义检索准确率", metadata={"category": "tech"}),

]

vectorstore.add_documents(docs)

# 混合搜索(向量 + 关键词)

results = vectorstore.similarity_search(

query="RAG 检索",

k=3,

)

for doc in results:

print(doc.page_content)

client.close() # 关闭连接4.3 Milvus + LangChain

# 安装依赖

# pip install pymilvus langchain-openai

from pymilvus import MilvusClient

from langchain_openai import OpenAIEmbeddings

from langchain_milvus import Milvus

# 初始化 Milvus(本地示例)

client = MilvusClient(uri="http://localhost:19530")

# 创建 collection

collection_name = "rag_demo"

if client.has_collection(collection_name):

client.drop_collection(collection_name)

client.create_collection(

collection_name=collection_name,

dimension=1536,

)

# 初始化 LangChain 向量存储

embeddings = OpenAIEmbeddings(model="text-embedding-3-small")

vectorstore = Milvus(

embedding_function=embeddings,

collection_name=collection_name,

connection_args={"uri": "http://localhost:19530"},

)

# 添加文档

from langchain.schema import Document

docs = [

Document(page_content="Milvus GPU 加速实现亿级向量毫秒检索", metadata={"gpu": True}),

Document(page_content="分布式架构支持水平扩展到百亿向量", metadata={"scale": "large"}),

]

vectorstore.add_documents(docs)

# 查询检索

results = vectorstore.similarity_search("大规模向量检索", k=3)

for doc in results:

print(doc.page_content)4.4 迁移路径:从 Chroma 到托管方案

如果你用 Chroma 做原型,现在要迁移到生产环境,这里是一个三步流程:

Step 1:导出 Chroma 数据

import chromadb

client = chromadb.PersistentClient(path="./chroma_db")

collection = client.get_collection("my_collection")

# 获取所有向量

results = collection.get(include=["embeddings", "metadatas", "documents"])

vectors = results["embeddings"]

metadatas = results["metadatas"]

documents = results["documents"]Step 2:批量导入目标数据库

# 导入到 Pinecone

from langchain.schema import Document

docs = [

Document(page_content=documents[i], metadata=metadatas[i])

for i in range(len(documents))

]

pinecone_store.add_documents(docs) # 批量上传Step 3:重建索引并验证

# 验证检索结果一致性

chroma_results = collection.query(query_texts=["test query"], n_results=5)

pinecone_results = pinecone_store.similarity_search("test query", k=5)

# 对比召回率,确认迁移成功迁移时间估算:100 万向量从 Chroma 到 Pinecone,约 2-3 小时(取决于网络带宽)。建议在低峰期执行,避免影响服务。

第五章:总结与选型决策表

5.1 一图胜千言:选型决策表

| 场景 | 数据量 | 团队规模 | 推荐方案 | 理由 |

|---|---|---|---|---|

| 原型验证 | <100万 | 1-2人 | Pinecone免费层 | 零运维,快速启动,免费额度够用 |

| 生产级中小 | 100万-1亿 | 3-5人,无运维 | Weaviate云托管 | 混合搜索准确率高,存储计费成本低 |

| 生产级高频查询 | 100万-1亿 | 3-5人 | Weaviate云托管 | 查询不限费,高频场景性价比最高 |

| 生产级低频查询 | 100万-1亿 | 3-5人 | Pinecone付费 | 按查询计费,低频场景成本可控 |

| 大规模企业级 | >1亿 | 5+人+运维团队 | Milvus自托管 | GPU加速,水平扩展,长期成本低 |

| 多模态检索 | 不限 | 不限 | Weaviate | 内置多模态支持,开箱即用 |

| 知识图谱RAG | 不限 | 不限 | Weaviate | 图数据库基因,语义关系建模 |

| 轻量级/已有PG | <100万 | 不限 | pgvector | 零额外成本,扩展开箱即用 |

5.2 三步走选型流程

-

评估数据量和增长预期

- 当前有多少文档?

- 预计一年后增长到多少?

- 增长速度是线性还是指数?

-

计算真实成本

月成本 = 存储成本 + 查询成本 + 运维成本使用上面的公式代入你的数据量,对比托管方案和自托管方案的总成本。运维成本别忘了算——托管方案省运维,但自托管长期摊薄可能更便宜。

-

小规模测试验证

- 用 10% 的数据做原型测试

- 测 P99 延迟、召回率、QPS

- 确认符合预期后再全量迁移

5.3 三个常见选型错误

错误 1:只看价格不看运维成本

很多人选开源方案”因为免费”,但自托管的人力成本往往被忽视。招聘一个懂 Kubernetes 的运维,年薪 $50k+;培训现有团队,时间成本 1-2 个月。托管方案看起来贵,但省下的运维成本要算进去。

错误 2:忽略向量维度对性能的影响

OpenAI 的 text-embedding-3-large 输出 3072 维向量——比 text-embedding-3-small(1536 维)大 2 倍。向量维度越高,检索延迟越高、存储成本越大。选型前先确定 Embedding 模型,别选了数据库才发现不支持高维向量。

错误 3:选型后才发现不支持需要的 Embedding 模型

Pinecone 只存储向量,不提供向量化服务——你得自己生成 Embedding 再上传。Weaviate 内置向量化模块,支持 OpenAI、Cohere、本地模型直接接入。如果你需要”上传文档自动向量化”,选型时要确认这个能力。

选型这事没有标准答案。搞清楚你的场景、算清楚真实成本、小规模验证后再全量部署。希望这篇文章能帮你少踩坑,选到最适合的方案。

如果你在实战中遇到其他问题,欢迎留言交流——我也还在持续踩坑中。

常见问题

Pinecone、Weaviate、Milvus 哪个延迟最低?

高频查询场景哪个最省钱?

没有运维团队选哪个?

从 Chroma 迁移需要多久?

向量维度怎么选?

知识图谱 + RAG 选哪个?

16 分钟阅读 · 发布于: 2026年4月27日 · 修改于: 2026年4月28日

相关文章

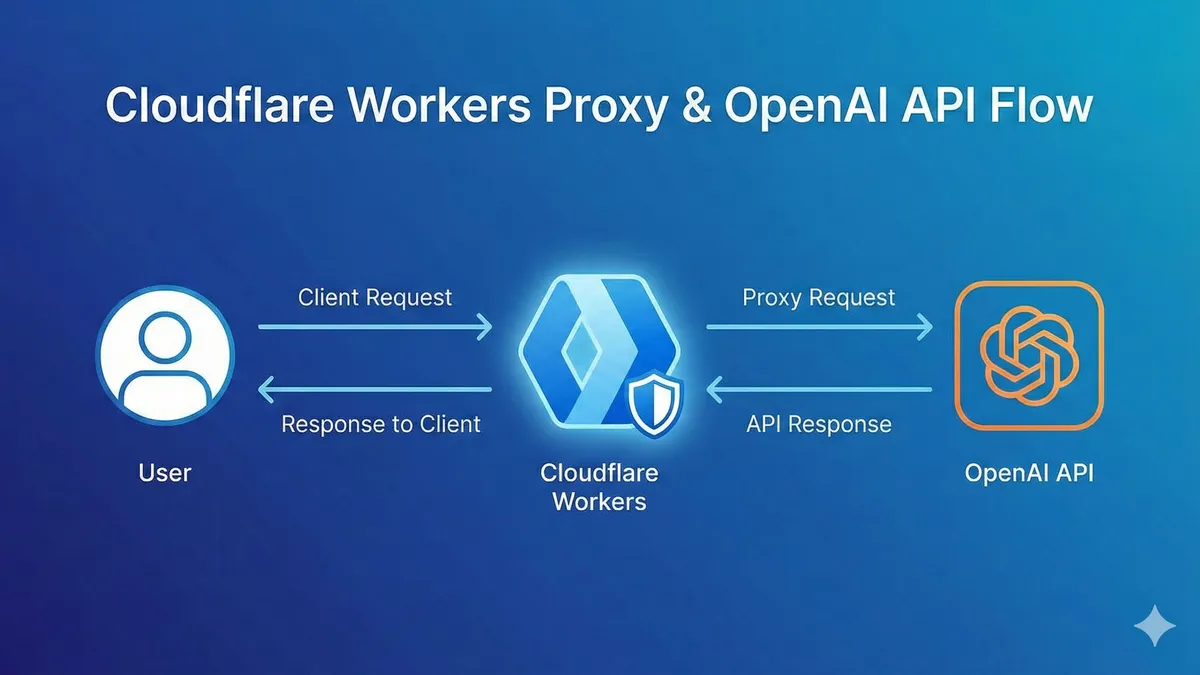

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

AI重构10000行老代码:2周完成1个月工作量的真实复盘

AI重构10000行老代码:2周完成1个月工作量的真实复盘

OpenAI接口总是超时?用Workers搭建私人通道,0成本更稳定

评论

使用 GitHub 账号登录后即可评论