谷歌 AI 生态中的数据隐私与安全:NotebookLM 企业版与 Antigravity 的安全隔离机制

“我们能把核心产品的技术文档上传到那个AI工具里分析吗?”

会议室里,CTO 转头看向安全负责人。后者推了推眼镜,沉默了三秒:“我需要看看他们的数据处理协议。”

这个场景,我在过去一年的企业AI咨询中见过无数次。CTO 看到了 AI 提效的机会,CISO 看到了数据泄露的风险。两边都有道理,两边都在等一个答案。

说实话,这个问题没有标准答案。但了解清楚 Google 在 NotebookLM 企业版和 Antigravity 上的安全机制,至少能帮你做出更 informed 的决策。

这篇东西,就是写给那些既要拥抱 AI、又得守住安全底线的企业决策者的。我们会聊:NotebookLM 怎么处理你的数据、Antigravity 的本地-云端架构、以及 VPC-SC 这些工具怎么保护 API 调用。

没有软文,只有技术事实和合规考量。

NotebookLM 企业版:数据不出域的承诺

先说 NotebookLM,这是 Google 面向企业知识管理的 AI 工具。

核心问题:我上传的文档,会不会被 Google 拿去训练模型?会不会被人工审查?会不会泄露给别的用户?

官方承诺(Workspace Enterprise 版)

根据 Google Workspace Admin Help 的文档,对于企业版用户:

- 不用于模型训练:你的上传内容、查询和模型响应不会被用于训练生成式 AI 模型

- 无人工审查:不会被人工审查员查看

- 企业级数据保护:NotebookLM 于 2025 年 2 月成为 Google Workspace 核心服务,受 Workspace 企业级数据保护条款约束

这和个人版有本质区别。个人版的条款写着:如果你提供反馈,“人工审查员可能会查看你的查询、上传内容和模型响应”。对企业来说,这是不可接受的风险。

数据存储位置

根据 Bay Tech Consulting 的分析,NotebookLM 企业版的数据存储在 Google Workspace 的基础设施中,遵循与客户签订的合同条款。这意味着数据驻留和合规性由 Workspace 的企业协议覆盖。

数据留存

- 查询不会被保存

- 上传的材料、保存的笔记和音频概述会被存储,直到你主动删除

- 删除后,遵循 Google Workspace 的标准删除流程

实际意义

对于金融、医疗、法律等敏感行业,这意味着你可以相对放心地把内部文档交给 NotebookLM 处理——前提是你在使用 Workspace Enterprise 版,而不是个人版。

但注意,“相对放心”不等于”绝对安全”。Google 仍然可以因法律要求、安全需求或服务质量改进而访问数据,只是这些访问受严格控制和审计。

Gemini API 的数据治理

NotebookLM 底层调用的是 Gemini 模型。了解 Gemini API 的数据处理逻辑,对评估风险很重要。

数据使用的三个层次

1. 消费者版(Consumer):

- 数据可能被记录和存储,用于安全、监控、QA、滥用防护

- 人工审查可能发生

- 数据可能被用于改进服务

2. Workspace 版:

- 遵循 Workspace 数据处理协议

- 不用于模型训练

- 人工审查仅在特定情况下发生(如滥用调查)

3. Enterprise 版(Gemini Enterprise/Cloud):

- 最严格的数据隔离

- 支持数据驻留(Data Residency)承诺

- 支持客户管理的加密密钥(CMEK)

- 支持 VPC Service Controls

GDPR 合规

对于欧洲用户,Gemini 支持区域数据驻留保证。数据在静态存储时位于指定区域,符合 GDPR 要求。但注意,模型推理可能需要跨区域调用,这是目前的技术限制。

关键建议

如果你的企业有严格的合规要求,不要用免费的消费者版做商业用途。至少使用 Workspace Enterprise,最好使用 Gemini Enterprise Cloud 版。

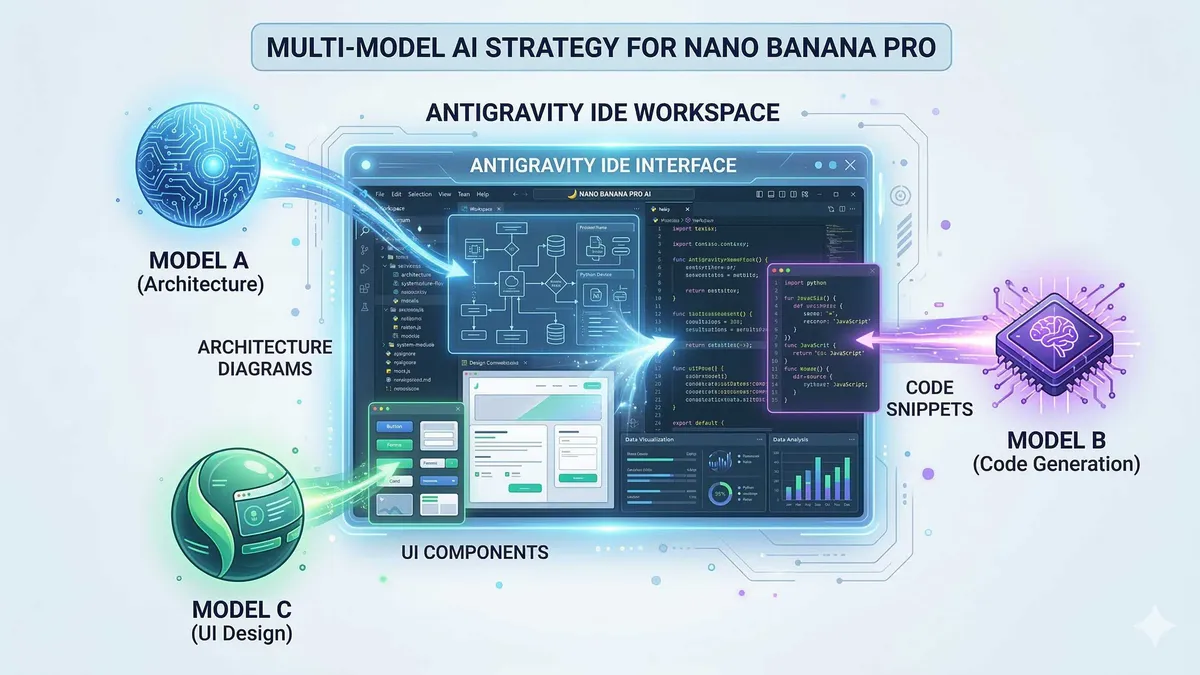

Antigravity 的本地-云端架构

Antigravity 是 Google 的 Agent-First IDE,它的安全架构和 NotebookLM 有些不同。

执行模型

根据 Google Codelabs 的描述,Antigravity 有一个混合架构:

- 本地执行:代码编辑、文件操作、本地脚本运行在用户机器上

- 云端推理:AI 模型调用(Gemini 3)发送到 Google 服务器处理

- 可选的自托管:企业版支持在 VPC 内运行部分组件

这意味着什么

你的源代码默认情况下不会被发送到云端——除非你明确要求 Agent 执行需要云端模型的任务。比如:

- 本地的代码补全?本地处理

- 调用 Gemini 3 生成代码?发送到云端

- 让 Agent 分析整个代码库?部分元数据可能需要上传

代码安全策略

对于企业使用 Antigravity,建议采取以下策略:

- 敏感代码库隔离:核心算法、密钥管理代码不要放入 Antigravity 管理的项目

- 网络隔离:使用 VPC-SC(后面详细讲)限制 Agent 能访问的外部服务

- 审计日志:开启操作日志,记录 Agent 执行了哪些操作、调用了哪些 API

企业部署架构

根据 Augment Code 的分析,Antigravity 企业版支持 Cloud Run 架构,配合:

- Cloud Storage 用于仓库内容

- BigQuery 用于代码元数据和搜索

- VPC Service Controls 和 IAM 集成用于企业安全

这种架构允许企业在私有云环境中运行 Antigravity 的部分组件,同时保留云端 AI 的能力。

VPC Service Controls:构建安全边界

VPC Service Controls(VPC-SC)是 Google Cloud 提供的一项安全功能,用于构建数据安全边界。

核心概念

VPC-SC 允许你定义一个”服务边界”(Service Perimeter),在这个边界内:

- 数据可以自由流动

- 外部访问被阻止或严格审计

- 即使是 Google 内部服务,也必须遵守边界规则

在 AI 工作负载中的应用

对于使用 Gemini、NotebookLM、Antigravity 的企业,VPC-SC 可以实现:

- 防止数据外泄:确保代码、文档不会意外同步到个人 Google 账户

- 限制 API 调用:只允许从特定 VPC 调用 Gemini API

- 审计所有访问:记录谁、什么时候、通过什么方式访问了 AI 服务

配置示例

# 简化的 VPC-SC 配置概念

title: "AI Services Perimeter"

resources:

- projects/my-enterprise-project

restrictedServices:

- gemini.googleapis.com

- notebooklm.googleapis.com

- storage.googleapis.com

ingressRules:

- from:

identities:

- serviceAccount:antigravity-sa@my-project.iam.gserviceaccount.com

to:

operations:

- "*"实际部署建议

根据 InfoQ 的实践报告,在企业规模部署 VPC-SC 需要:

- 分阶段实施:先在测试环境验证,再推广到生产

- 服务映射:梳理所有依赖的 Google 服务,避免意外阻断

- 突破策略(Break-glass):为紧急情况准备绕过机制

- 持续监控:VPC-SC 日志与 SIEM 集成,实时告警异常

企业 AI 采用的合规检查清单

说了这么多,实际操作时怎么评估一个 AI 工具是否适合你的企业?

数据分类评估

首先,对你要输入 AI 的数据进行分类:

- 公开数据:产品官网内容、已发布的文档——低风险

- 内部数据:技术文档、项目计划——中风险,需确认服务条款

- 敏感数据:客户信息、财务数据、核心算法——高风险,需额外保护

供应商评估清单

对于每个 AI 工具,确认以下问题:

数据训练政策:

- 明确承诺不用于模型训练?

- 有合同级别的保证还是仅用户协议?

- 人工审查的条件是什么?

数据驻留:

- 支持指定区域存储?

- 传输中是否加密?

- 静态存储加密方式?

合规认证:

- SOC 2?

- ISO 27001?

- GDPR 合规声明?

- 行业特定认证(如 HIPAA、PCI-DSS)?

企业级功能:

- 支持 SSO/SAML?

- 支持审计日志?

- 支持细粒度权限控制?

- 支持数据导出/删除?

实施策略

阶段1:试点(Pilot)

- 选择非敏感项目试用

- 建立使用政策和培训材料

- 监控使用情况和反馈

阶段2:受控推广

- 扩展到更多团队

- 实施 VPC-SC 等安全措施

- 建立事件响应流程

阶段3:全面采用

- 集成到标准工作流程

- 持续合规审计

- 优化成本和安全平衡

结语

回到开头那个会议室的场景。

CTO 问:“我们能把核心产品的技术文档上传到那个AI工具里分析吗?”

现在,安全负责人可以给出更 nuanced 的回答:

“如果是 NotebookLM Enterprise 版,数据不出域、不用于训练,合规风险可控。但核心算法文档我还是建议先用脱敏版本测试。另外,我们需要配置 VPC-SC 确保数据不会意外流出。

“Antigravity 可以用,但敏感代码库要隔离。让开发人员在本地处理核心代码,AI 辅助做外围功能。”

这不是”能用”或”不能用”的二元答案。这是关于风险分级、技术措施、合规流程的综合判断。

AI 转型的压力不会消失。竞争对手在用,客户期待更快的产品迭代,内部团队需要效率工具。但安全合规的底线也不能丢——一次数据泄露的代价,可能超过 AI 带来的所有收益。

关键是在这个张力中找到平衡点。了解清楚工具的安全机制、建立合适的使用政策、实施必要的技术控制。

Google 的 AI 生态(NotebookLM、Antigravity、Gemini Enterprise)在企业级安全方面做得相对成熟。有清晰的数据处理协议、有 VPC-SC 这样的技术控制手段、有合规认证背书。

但最终,安全是企业的责任。工具提供商给你的是能力,怎么用、怎么保护,取决于你的决策。

希望这篇东西,能帮你在那个会议室里,给出更 informed 的答案。

常见问题

NotebookLM企业版与个人版在数据隐私方面有什么根本区别?

**模型训练**:

• 企业版:明确承诺不用于训练生成式AI模型

• 个人版:如果提供反馈,人工可能审查查询和上传内容

**人工审查**:

• 企业版:不会被人工审查员查看

• 个人版:审查员可能查看查询、上传内容和模型响应

**数据保护**:

• 企业版:受Workspace企业级数据保护条款约束(2025年2月成为核心服务)

• 个人版:受标准Google服务条款约束

对于企业敏感信息,个人版的审查条款构成不可接受的风险。

Gemini API三个版本(Consumer/Workspace/Enterprise)的数据治理有何不同?

**Consumer版**:

• 数据可能用于安全、监控、QA、滥用防护

• 人工审查可能发生

• 数据可能用于改进服务

• 不推荐商业用途

**Workspace版**:

• 遵循Workspace数据处理协议

• 不用于模型训练

• 人工审查仅在滥用调查等特定情况

• 适合一般企业使用

**Enterprise版**:

• 最严格的数据隔离

• 支持数据驻留(Data Residency)

• 支持客户管理加密密钥(CMEK)

• 支持VPC Service Controls

• 适合有严格合规要求的组织

企业应至少使用Workspace版,敏感行业建议使用Enterprise版。

Antigravity的代码安全机制是怎样的?企业如何安全使用?

**本地执行**:

• 代码编辑、文件操作、本地脚本在用户机器运行

• 源代码默认不发送到云端

**云端推理**:

• AI模型调用(Gemini 3)发送到Google服务器

• 代码补全等本地功能无需上传

**企业安全建议**:

1. **敏感代码库隔离**:核心算法、密钥管理代码不放Antigravity项目

2. **网络隔离**:使用VPC-SC限制Agent可访问的外部服务

3. **审计日志**:开启操作日志,记录Agent执行的操作和API调用

4. **分层使用**:核心代码本地处理,AI辅助外围功能

企业版支持Cloud Run架构,可在VPC内运行部分组件。

VPC Service Controls如何保护企业AI工作负载?

**核心机制**:

• 定义Service Perimeter(服务边界)

• 边界内数据自由流动

• 边界外访问被阻止或严格审计

**在AI场景中的应用**:

1. **防止数据外泄**:阻止代码、文档意外同步到个人Google账户

2. **限制API调用**:只允许特定VPC调用Gemini/NotebookLM API

3. **审计访问**:记录谁、何时、如何访问AI服务

**部署要点**:

• 分阶段实施,先在测试环境验证

• 映射所有依赖的Google服务,避免意外阻断

• 准备突破策略(Break-glass)应对紧急情况

• VPC-SC日志与SIEM集成,实时告警

VPC-SC是技术控制手段,需要配合使用政策和流程才能发挥最大效果。

企业评估AI工具时应关注哪些合规要点?

**数据训练政策**:

• 是否有明确的不用于训练承诺?

• 是合同级别还是仅用户协议?

• 人工审查的条件和范围?

**数据驻留与安全**:

• 是否支持指定区域存储?

• 传输和静态加密方式?

• 数据删除机制?

**合规认证**:

• SOC 2、ISO 27001

• GDPR、CCPA等隐私法规

• 行业特定认证(HIPAA、PCI-DSS等)

**企业功能**:

• SSO/SAML支持

• 审计日志

• 细粒度权限控制

• 数据导出能力

**实施建议**:分三阶段推进——试点验证→受控推广→全面采用,每阶段建立相应的安全控制和审计机制。

10 分钟阅读 · 发布于: 2026年2月28日 · 修改于: 2026年3月18日

相关文章

OpenClaw 2026.3 实战进阶:新版本核心功能与最佳实践

OpenClaw 2026.3 实战进阶:新版本核心功能与最佳实践

OpenClaw 实战完全手册:从入门到精通

OpenClaw 实战完全手册:从入门到精通

不做单一模型的囚徒:在 Antigravity 中灵活切换 Gemini 3、Claude 4.5 与 GPT-OSS

评论

使用 GitHub 账号登录后即可评论