AI の「魂」を覗き見る:Gemini 3.1 の思考チェーン(CoT)漏洩を利用したコードロジックデバッグ

深夜2時、私は画面上の奇妙な Python コードを前に途方に暮れていました。

Gemini 3.1 Pro が生成してくれた再帰関数は、一見問題なさそうに見えましたが、テストを3回実行すると、3回とも異なる結果が返ってきました。ランダム数の問題ではなく、ロジックがある分岐で「漂流」しているのです。

「Thinking…」というアニメーションを10秒間見つめていたとき、ふと疑問が浮かびました。「こいつ、一体何を考えているんだ?」

正直に言って、AI を使ってコードを書いてきた長い間、私は AI を「ブラックボックス」として扱ってきました。プロンプトを入力し、コードが出力される。その間に何が起きているのか?分からないし、気にしていませんでした——コードに問題が出るまでは。

その夜、私は偶然あるテクニックを発見しました。特定のプロンプト設計によって、Gemini の「思考のメモ帳」を露出させることができるのです。美化された「思考プロセス」の要約ではなく、本物の、生の、時には少し混乱した内部推論チェーン(思考チェーン)です。

あの瞬間、私は AI の「魂」を垣間見たような気がしました。

この記事では、このテクニックを利用して AI のコードをデバッグする方法について解説します。オカルトではなく、実戦的な技術手法です。

思考チェーン(CoT)漏洩とは

まず、いくつかの概念を整理しましょう。

**思考チェーン(Chain of Thought, CoT)**は、現在の大型モデルが複雑な推論を行うための核心的なメカニズムです。簡単に言うと、モデルが最終的な回答を出す前に、思考プロセスを書き出すようにすることです。数学の問題を解くときに、まず計算用紙に手順を書くのと同じです。

Gemini 3/3.1 Pro には thinking_level というパラメータがあり、モデル内部の推論の深さを制御できます。レベルが低いと直接回答を出し、レベルが高いと多段階の推論、自己修正、パスプランニングを行います。

しかし、ここで注意点があります。公式に表示される「Thinking」ブロックは、実は二次加工された要約であり、生の思考チェーンではありません。

Reddit のある開発者が、特定の入力によって Gemini 3 Pro が真の生の思考チェーンを「漏洩」させることを発見しました。そこには、自己疑念、誤った試行、さらには「再帰ループ」さえ含まれる真実の推論プロセスが記録されています。

AI が「頭」の中で独り言を言っている様子を想像してみてください。

「よし、ユーザーはソートアルゴリズムを求めている… クイックソート?いや、データ量が少なすぎる、再帰のオーバーヘッドが大きいな… バブルソートにするか?いや、低レベルすぎる… 待てよ、Python 組み込みの sorted を使えるが、ユーザーは自作したいと言っている… ならマージソートにしよう。安定しているし効率も悪くない…」

このような「モノローグ」レベルの情報は、プロンプトのデバッグやコード品質の向上において計り知れない価値があります。

思考チェーン漏洩をトリガーする方法

実戦的な部分に入りましょう。

Gemini 3.1 Pro の漏洩は、通常以下のようなケースで発生します。

シーン1:極端に複雑なロジック問題

問題の複雑さが特定の閾値を超えると、モデルは正しく回答するために中間推論ステップを露出させざるを得なくなります。このとき、API が返す生のトークンストリームを注意深く観察すると、<thinking> タグ内の内容が通常よりも遥かに豊富であることに気づくかもしれません。

シーン2:モデルが「行き詰まった」時の自己修正

Reddit ユーザーが報告した事例:Gemini が再帰ループやロジックの行き止まりに陥ったとき、それは「unhinged(制御不能に近い)」状態を示します。この状態では、モデルの内部チェック機構が思考チェーンを「sanitize(クリーンアップ)」する暇がなく、生の推論が漏洩することがあります。

シーン3:特定のプロンプト設計

漏洩の確率を高めるプロンプトのテクニックがあります。

- 「誤った試行も含めて、あなたの思考プロセスをすべて見せてください」と明示的に要求する

- 「計算用紙」フレームワークを使用する:「まず計算用紙で問題を分析してから、回答を出してください」

- 追及型プロンプト:「今の推論には飛躍があります、各ステップを詳しく説明してください」

実用的なヒント:Gemini API の呼び出しで thinking_level: "high" を設定し、返された thinking フィールドを解析してみてください。時にそこには text フィールドよりも価値のある情報が隠されています。

思考チェーンからロジック問題を診断する

漏洩した思考チェーンは何に役立つのでしょうか?いくつかの実例を挙げます。

事例1:隠れた前提条件の発見

以前、ユーザー入力を処理する関数を Gemini に書かせた時のことです。コードは問題なさそうでしたが、思考チェーンの中に次の一文を見つけました。

「ユーザーの入力は常に有効な JSON 形式であると仮定する…」

待ってください。入力が必ず JSON だなんて一言も言っていません!この前提はモデルが勝手に追加したものです。思考チェーンを見ていなければ、このリスクはそのまま本番環境に紛れ込んでいたでしょう。

事例2:推論のショートカットの発見

別の例:Gemini にデータベースクエリの最適化を依頼しました。生成されたコードはインデックスを使用しており、プロフェッショナルに見えました。しかし思考チェーンにはこうありました。

「ユーザーはクエリの最適化を求めている… うん、インデックスの追加が最も一般的な最適化手法だ… インデックスの追加を提案しよう…」

問題が分かりますか?モデルは既存のクエリプランやデータ分布、あるいはインデックスがすでに存在するかどうかを全く分析していません。「最も正しい」回答ではなく、「最も手間のかからない」回答を選んだのです。

事例3:自己矛盾の発見

最も興味深いのは、モデルが自分の考えを否定した時です。思考チェーンに以下のように現れることがあります。

「手法 A はこの境界条件下では失敗するだろう… だが、ほとんどのケースではうまく機能するため、やはり手法 A を推奨する」

このような自己矛盾の露出により、どこに防御的なコードやテストケースを追加すべきかが分かります。

CoT を利用したプロンプトのデバッグと最適化

思考チェーンはコードのデバッグツールであるだけでなく、プロンプトを最適化するための「X線」でもあります。

テクニック1:プロンプトの理解のされ方をチェックする

自分では明確に伝えたつもりでも、モデルが別の解釈をしていることがあります。思考チェーンを観察することで、モデルが何を「聞いた」のかを確認できます。

例えば、「効率的な関数を書いて」と言ったとします。

モデルは思考チェーンの中で以下のように解釈しているかもしれません。

- 「効率的 = 時間計算量が低い」

- 「効率的 = メモリ使用量が少ない」

- 「効率的 = コードが簡潔」

解釈が異なれば、出力されるコードも全く異なります。この曖昧さに気づけば、プロンプトをより正確に修正できます。

テクニック2:知識の空白の発見

モデルが思考チェーンの中で「うーん… 確信が持てない…」「おそらく…」といった表現を使っている場合、その知識点について確信が持てていないことを示しています。その場合、以下のような対応が考えられます。

- プロンプトでより多くのコンテキストを提供する

- あるいは、よりシンプルな実装方法に変更する

テクニック3:推論方向の誘導

モデルがどのように思考しているかが見えれば、プロンプトを調整して意図的に誘導することができます。

例えば、モデルが常に再帰的なアプローチを優先していることが分かれば、「再帰の方が明らかに簡潔である場合を除き、反復的なアプローチを優先して」と付け加えることができます。

あるいは、モデルが境界条件を無視している場合は、「空入力や極端な値の境界処理に特に注意して」と加えることができます。

限界と注意事項

正直に言って、この手法は万能ではありません。

限界1:漏洩が不安定

Google は思考チェーンの露出を制御しようと努力しています。どれだけ見ることができるかは、モデルのバージョン、パラメータ設定、さらには運に大きく左右されます。今日使えたテクニックが、明日には無効になっているかもしれません。

限界2:思考チェーン自体が誤ることもある

思考チェーンはモデルの「思考プロセス」を示すものであり、そのプロセスが正しいことを保証するものではありません。モデルが思考チェーンの中で自信満々に推論を展開したとしても、最終的な結論が間違っていることもあります。

限界3:過度な依存は効率を低下させる

思考チェーンの分析には時間がかかります。単純なタスクなら、直接コードの出力を確認した方が早いです。複雑なロジックや繰り返し問題が発生する場合にのみ、このテクニックを使用してください。

倫理的なリマインダー

Google 公式は、ユーザーが生の思考チェーンを見ることを望んでいません。このような「漏洩」は、モデルの内部メカニズムの覗き見とみなされる可能性があります。正式なプロジェクトで使用する際は、以下の点に注意してください。

- 漏洩した思考チェーンのみに基づいて重要な決定を下さない

- API ドキュメントの更新に注意し、公式がいつでも挙動を変える可能性があることを理解する

- サービス利用規約を尊重する

結び

結局のところ、思考チェーンの漏洩を利用して AI のコードをデバッグすることは、「リバースエンジニアリング」的な思考です。

私たちは AI を「ブラックボックスの神託」として扱い、問題を投げ入れれば正しい答えが返ってくると期待しがちです。しかし現実は、AI も間違えますし、空白地帯もありますし、近道をすることもあります。

AI の「計算用紙」を見ることができるようになれば、あなたは受動的な「回答の受け取り手」から、能動的な「推論の監査役」へと変わります。この視点の転換は、より良いプロンプトを書き、より信頼性の高いコードを生成するために、確かな助けとなります。

あの日の深夜3時、私は Gemini の思考チェーンを分析したことで、再帰の終了条件を処理する際に境界条件が一つ漏れていることを突き止めました。プロンプトに明確な注意書きを加え、再生成したところ、問題は解決しました。

コードは修正されましたが、私が心に刻んだのは最終的な答えではなく、思考チェーンの中で自己修正を行っていた AI の姿でした——AI も間違えますが、より良くなろうと試行錯誤しています。そして私たちにできるのは、その試行錯誤を読み解く術を学ぶことなのです。

もしあなたも試してみたいなら、少し複雑なプログラミング問題を選び、高い thinking_level で Gemini 3.1 Pro を呼び出し、「Thinking…」の裏側に何が隠されているかを注意深く見てみてください。そこで発見するものに、驚かされるかもしれません。

もしかしたら、あなたも AI の「魂」を垣間見ることができるかもしれません。

FAQ

Chain of Thought(思考チェーン)とは何ですか?なぜ AI コードのデバッグに役立つのですか?

AI コードのデバッグにおける価値は以下の通りです:

• モデルがどのような隠れた前提(例:「入力は常に JSON である」など)を置いているかを確認できる

• モデルが真に問題を理解しているのか、あるいは推論の近道をしているだけなのかを把握できる

• モデルの自己矛盾を発見し、潜在的なバクを事前に予測できる

簡単に言うと、思考チェーンは AI の「計算用紙」であり、そこには「独り言」レベルの推論の詳細が隠されています。

Gemini 3.1 Pro で思考チェーンの漏洩をトリガーするにはどうすればよいですか?

1. **thinking_level パラメータの設定**:「high」レベルを使用して推論の深さを高めます

2. **複雑な問題の提示**:問題の複雑さが閾値を超えると、モデルはより多くの中間推論ステップを露出させざるを得なくなります

3. **特定のプロンプト設計**:

- 「誤った試行も含めて、思考プロセスを見せてください」と要求する

- 「計算用紙」フレームワークを使用する:「まず計算用紙で分析して」

- 追及型プロンプト:「今の推論には飛躍があります、詳しく説明してください」

注意:漏洩は不安定であり、モデルのバージョンや公式の制限ポリシーに左右されます。

思考チェーンからどのような種類のロジック問題を発見できますか?

**隠れた前提条件**:モデルが検証なしに勝手に追加した前提(入力形式やデータの範囲など)

**推論のショートカット**:モデルが分析手順を省き、「最も正しい」回答ではなく「最も一般的」な回答を出すこと

**自己矛盾**:モデルがある手法に問題があることに気づきながら、それを推奨してしまうような矛盾(境界条件の検証が必要なサイン)

これらを発見したら、プロンプトに明示的な制約やリマインダーを追加して修正できます。

思考チェーンを活用してプロンプトをデバッグする実用的なテクニックは?

**理解のズレのチェック**:思考チェーンの中でモデルが指示をどう理解したかを観察し、意図しない曖昧さを発見する

**知識の空白の発見**:「確信がない」「おそらく」といった迷いの表現に注目し、コンテキストの追加提供の必要性を判断する

**推論方向の誘導**:観察された思考パターンに基づき、「反復的な方法を優先」「境界処理に注意」といった具体的な指示をプロンプトに加える

思考チェーンはプロンプトの「X線写真」のようなもので、あなたが「何を言ったか」ではなく、モデルが「何を聴いたか」を見せてくれます。

思考チェーン漏洩を利用する際の限界やリスクは?

**不安定性**:Google は思考チェーンの露出を制御しており、バージョン更新によってテクニックが無効になる可能性があります

**信頼性の問題**:思考チェーン自体が誤ることもあり、提示された思考プロセスが正しいとは限りません

**効率のコスト**:分析に時間がかかるため、単純なタスクには向きません

**倫理的リスク**:公式には推奨されていない手法であり、本番環境で漏洩した思考チェーンのみに依存して重要な決定を下すべきではありません

あくまでデバッグや学習のツールとして、正式なプロジェクトでは慎重に使用することをお勧めします。

5 min read · 公開日: 2026年2月27日 · 更新日: 2026年3月18日

関連記事

OpenClaw 2026.3 実践アドバンス:新バージョンのコア機能とベストプラクティス

OpenClaw 2026.3 実践アドバンス:新バージョンのコア機能とベストプラクティス

OpenClaw 実践完全マニュアル:入門から精通まで

OpenClaw 実践完全マニュアル:入門から精通まで

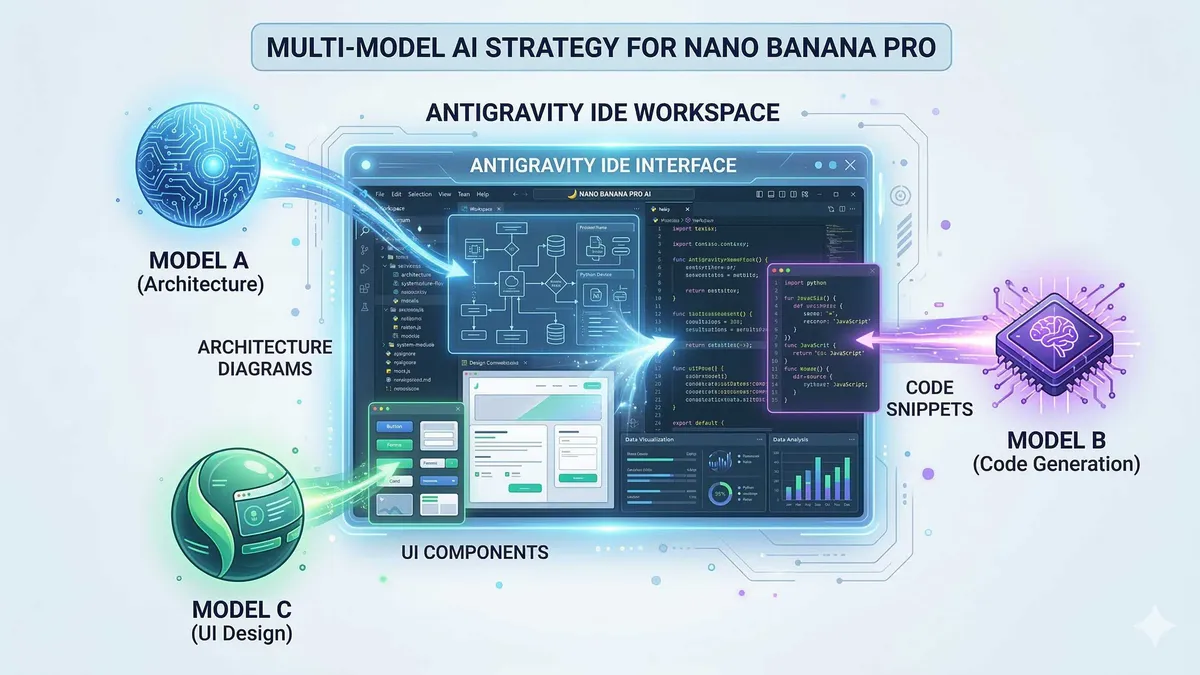

単一モデルの囚人にならない:Antigravity で Gemini 3、Claude 4.5、GPT-OSS を柔軟に使い分ける方法

コメント

GitHubアカウントでログインしてコメントできます