Veo 3キャラクター一貫性完全ガイド:Scenebuilderで繋がりのあるマルチショット動画を作る

正直に言うと、初めてVeo 3を使ってマルチショット動画を生成したとき、ノートパソコンを叩き壊しそうになりました。

あの感覚、わかりますか? 一晩かけて5つのショットからなる短編脚本を練り上げ、期待に胸を膨らませて一つずつ生成していったのです。結果はどうだったかというと、最初のショットの主人公は黒髪の短髪で青いスーツを着ていたのに、2番目のショットでは突然茶色の長髪にグレーのパーカー姿になり、3番目のショットに至っては顔の形まで変わってしまい、まるで別人になってしまいました。

私は画面を見つめながら、心の中でこう叫びました。「これは七つ子の物語を作ってるつもりはないんだぞ!」

もしあなたも同じ問題に直面したことがあるなら、おめでとうございます。あなただけではありません。キャラクターの外見が一定しないことは、AI動画生成において最も頭を悩ませる問題の一つです。しかし、大量のテストと研究を経て、私は真に効果的な方法を見つけました。今日の記事では、そのすべての経験を包み隠さずお伝えします。

なぜAI動画のキャラクターはいつも「漂流」するのか?

解決策を話す前に、まず理解しなければならないことがあります。なぜAI動画の中のキャラクターはコロコロ変わるのでしょうか? これを理解して初めて、適切な処方箋が出せます。

AIは実は「記憶喪失」

これが最も核心的な問題です。Veo 3、Runwayを含め、すべてのAI動画生成モデルには致命的な欠陥があります。それは長期記憶がないことです。

どういうことかというと、最初のショットで黒いスーツを着た男性を生成しても、AIはこのキャラクターの姿を覚えていません。2番目のショットを生成するとき、AIにとってそれは全く新しいタスクであり、まるで記憶喪失の患者と話すように、毎回自己紹介し直さなければならないのです。

私が使い始めた頃は、AIが自動的にキャラクターの一貫性を保ってくれると無邪気に信じていました。前のショットを生成したばかりなんだから、データは残っているはずだと。しかし後になって、自分が甘かったことに気づきました。AIモデルは各プロンプトを独立したタスクとして処理し、前後に関連性を持たせません。

文字による描写は生まれつき不正確

2つ目の問題は、私たちのプロンプトにあります。

考えてみてください。「黒いスーツを着た男性」という言葉は、どれだけの視覚的結果に対応するでしょうか? 30歳かもしれないし50歳かもしれない。アジア人かもしれないしヨーロッパ人かもしれない。スーツはイタリア製のスリーピースかもしれないし、普通のビジネススーツかもしれない。AIはこれほど広範な描写に直面すると、生成するたびに結果が異なるのは当然です。

レストランで「チャーハン」と注文するようなものです。シェフが違えば味も違います。毎回同じ味を求めるなら、正確なレシピ——米の量、卵の個数、醤油のブランド、炒める時間——を提供する必要があります。AIも同じで、描写が詳細であればあるほど、結果は安定します。

技術そのものの限界

もう一つの理由は技術的な側面にあります。

初期のAI動画生成は、実はフレームごとの生成でした。AIはまず第1フレームを生成し、それに基づいて第2フレームを、さらに第3フレームを……と生成していきます。各フレームで微細なズレが生じる可能性があります。これらのズレが蓄積されると、動画の終わりにはキャラクターが全くの別人になっていることがあります。

これは子供の頃に遊んだ伝言ゲームのようなものです。最初の人が「今日はいい天気だ」と言っても、最後の人には「今夜は夜食を食べよう」と伝わっているかもしれません。

業界の調査データによると、Runway Gen-4やVeo 3.1のようなキャラクター一貫性に特化したモデルが登場する前は、ユーザーのAI動画キャラクター一貫性に対する満足度は一般的に3-4点(10点満点)しかありませんでした。この問題がいかに普遍的かが見て取れます。

Veo 3のキャラクター一貫性を保つ3つの武器

幸いなことに、Googleや他のAI企業もこの問題を認識しています。Veo 3はキャラクターの一貫性を解決するためにいくつかの機能を特別に開発し、その効果は即座に現れます。Google Flowの公式データによると、これらの機能を使用した後、キャラクターの一貫性は60-70%向上します。

一つずつ詳しく説明しましょう。

武器1:Reference Images(参照画像)

これはVeo 3.1 Standardバージョン独自の機能です。簡単に言えば、1〜3枚の画像をアップロードして、AIに「私が欲しいキャラクターはこれだ、厳密にこれに従え」と指示できる機能です。

AIはアップロードされた画像からキャラクターの重要な特徴——顔の形、髪型、肌の色、目鼻立ちの比率など——を抽出し、動画生成時に極力それらの特徴を再現します。

この機能は特に以下の2つのシナリオに適しています:

- ゼロから外見を定義する必要がある、全く新しい架空のキャラクターを作る場合

- 特定の人物(歴史上の人物や小説のキャラクターなど)の姿を再現したい場合

正直なところ、この機能にも制限はあります。まず、Standardモードでしか使えず、Basic版のVeo 3では利用できません。次に、効果は良いものの、100%完璧にコピーできるわけではなく、やはり詳細な文字描写と組み合わせる必要があります。

何度かテストしてみましたが、実在の人物写真を参考図として使うと、AI生成キャラクターは確かに主要な特徴を捉えてくれますが、目の色が少しずれたり、髪のボリューム感が違ったりといった細部の違いは出ます。それでも全体的に見れば、純粋な文字描写よりはずっと良いです。

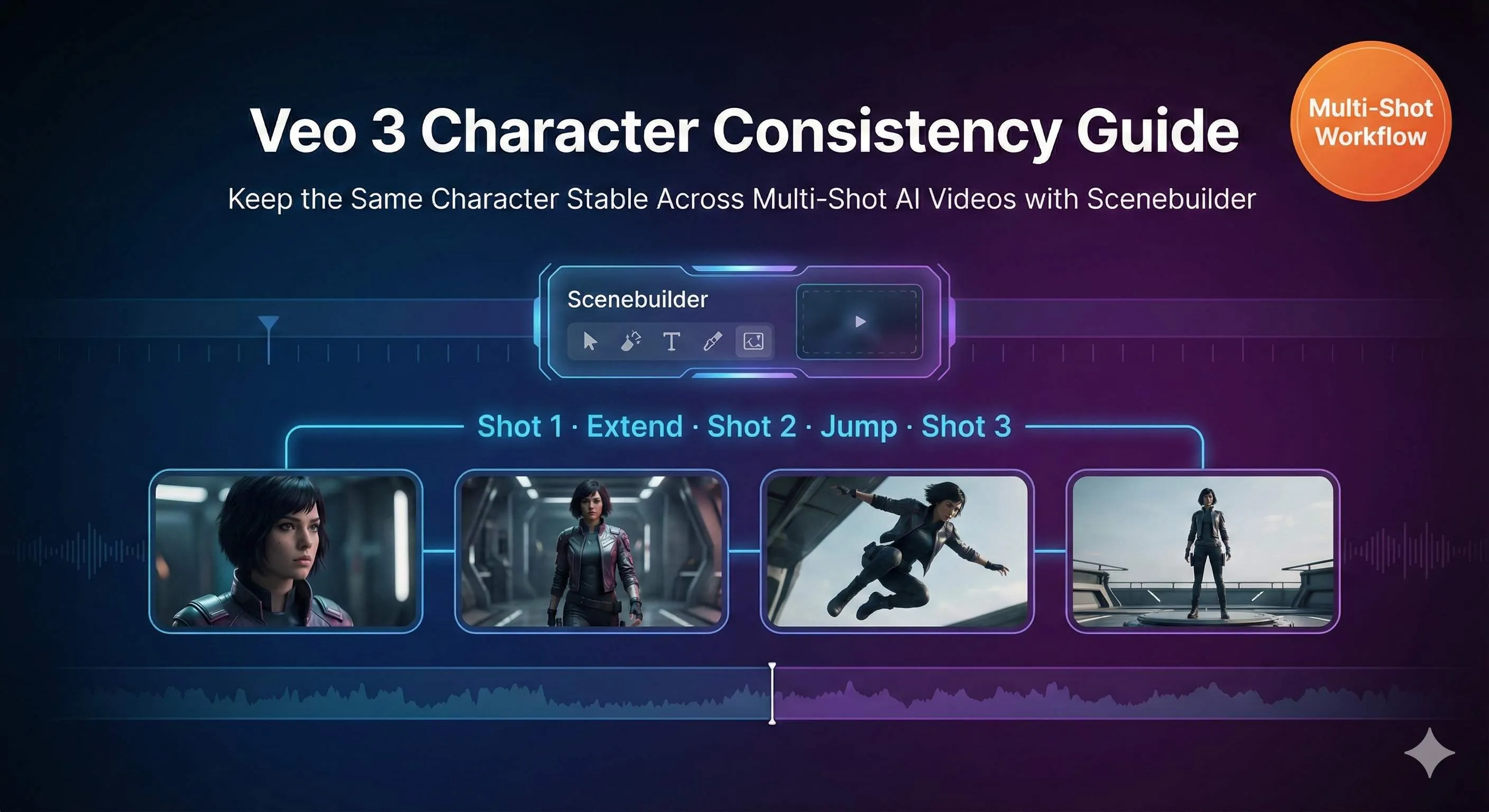

武器2:Scenebuilder(シーンビルダー)

これは私が最もよく使い、最も頼りにしている機能です。Scenebuilderこそが、マルチショットにおけるキャラクター一貫性の核心的なソリューションだと言えます。

その仕組みは、前のショットの視覚情報を使用して、次のショットの参考にするというものです。AIに「短期記憶」をインストールするようなもので、全ての歴史を覚えているわけではありませんが、少なくとも直前に起きたことは覚えられます。

Scenebuilderにはいくつかの重要な機能があります:

“Add to Scene”(シーンに追加)

満足のいくショットが生成できたら、このボタンをクリックします。すると動画がタイムラインに追加されます。この操作は本質的にAIに「このキャラクターの姿を覚えておいて、後でまた使うから」と伝えていることになります。

“Extend”(延長/継続)

これは次のショットを生成する主な方法です。前のショットの視覚的内容に基づいて、自然に繋がる後続の画面を生成します。重要なのは、キャラクターの外見を可能な限り維持してくれることです。

“Jump to”(ジャンプ/切り替え)

思い切った切り替え——例えば屋内シーンから屋外へ——を行いたい場合は、この機能を使います。不連続なカット切り替えを作成しますが、それでもキャラクターの外見の一貫性は極力保とうとします。

初めてScenebuilderを使って5つの繋がりのあるショットを生成できたとき、その達成感は言葉にできませんでした。キャラクターの服装、髪型、顔の特徴は基本的に一致しており、シーンの変化による光の加減の違いはありましたが、完全に許容範囲内でした。

Google Flowの公式ケーススタディによると、Scenebuilder使用後はキャラクター一貫性が60-70%向上します。言い換えれば、以前は10回中3回しか満足できなかったのが、6-7回に増えるということです。この向上は質的な飛躍です。

武器3:Ingredients to Video(要素から動画へ)

この機能は複雑なシーン、特に複数のキャラクターが同時に登場する場合に適しています。

ワークフローは以下の通りです:

- まずGemini 2.5 Flash Imageや他のツールを使って、各キャラクターやシーン要素の参考画像を個別に生成する

- これらの「原料(Ingredients)」をVeo 3にアップロードする

- Ingredients to Video機能を使って、AIにこれらの要素を一つのシーンに合成させる

この方法の利点は、各キャラクターに明確な視覚的参照があり、AIが空想する必要がないことです。例えば二人の会話シーンを作る場合、先にAとBのキャラクター立ち絵をそれぞれ生成し、Ingredients機能を使って会話ショットを合成できます。

私自身はあまり使いません。単独主人公のストーリーならScenebuilderで十分だからです。しかし、多人数インタラクションのある動画を作るなら、Ingredients to Videoは間違いなく最適な選択です。

実践操作:Scenebuilderで一貫した動画を作る

さて、理論は終わりました。ここからは実践です。完全なフローを一歩ずつガイドします。Veo 3を初めて使う人でも、これに従えば使いこなせるようになります。

ステップ0:「キャラクターバイブル」を作る

このステップはよく無視されますが、実は最も重要です。

Veo 3を開く前に、まず15〜30分かけて、詳細なキャラクター記述ドキュメント、通称「Character Bible(キャラクターバイブル)」を書いてください。このドキュメントには以下を含めます:

- 基本情報:年齢、性別、人種

- 髪:長さ、色、質感、スタイル(例:「肩までの長さの黒髪ウェーブ、センター分け、毛先が少し外ハネ」)

- 顔:目の色、眉の形、鼻の特徴、顎のライン、目立つ印(ほくろ、傷跡)

- 体型:スタイル、身長の雰囲気、姿勢の特徴

- 服装:各衣類のタイプ、色、素材、フィット感、アクセサリー

詳しければ詳しいほど良いです。私のおすすめは100〜150文字程度書くことです。

例:

28歳のアジア人女性、黒いストレートのロングヘアを低いポニーテールにしている。濃い茶色の目、やや太めの眉、小ぶりな鼻、丸みのある顎。白いコットンTシャツ(少しゆったりめで丸首)を着て、濃紺のジーンズ(スリムフィット、ロールアップ)を合わせ、白いキャンバススニーカーを履いている。痩せているが虚弱ではなく、自信に満ちた立ち姿で、少し顔を上げている。左手首に細い銀の腕時計をしている。

わかりましたか? この描写は十分に具体的で、AIが勝手に想像する余地はほとんどありません。これが必要な効果です。

多くの人は「そんなに詳しく書くのは面倒だ」と思うでしょう。正直、面倒です。しかし、この15分の投資が、3時間の再生成時間を節約してくれるのです。どう考えても割に合います。

ステップ1:基準ショットを生成する

Google Flowを開き、Veo 3を選択して、あなたのキャラクター記述を完全に貼り付け、そこに最初のショットのアクションとシーンを加えます。

例:

[完全なキャラクター描写を貼り付け]。彼女はカフェの入り口に立ち、ガラスのドアを押して中に入る。中景ショット、わずかにドリーイン。柔らかな自然光、暖かい午後の色調。

生成をクリックします。

ここで重要なポイント:最初のショットは何度か試す必要があるかもしれません。焦らず、妥協しないでください。最初のショットはシリーズ全体の基準となり、後のすべてのショットがこれを参照するからです。最初のショットでキャラクターの外見が不正確だと、その後の全てが台無しになります。

私は通常3〜5回生成し、最も満足のいくものを選びます。以下の点をチェックします:

- 顔の特徴は描写と合っているか?

- 服装の細部は正しいか?

- 全体のスタイルは期待通りか?

- 画質は十分か?(構図、光)

すべてに満足できて初めて、次のステップに進みます。

ステップ2:シーンに追加する

満足のいく動画の下に、いくつかのボタンが表示されます。**“Add to Scene”**をクリックします。

画面がタイムラインビューに切り替わり、先ほど生成した動画がタイムラインの最初の位置に表示されます。おめでとうございます、あなたの最初のショットが正式にロックされました。

この操作は簡単に見えますが、実は非常に重要なことを行っています。Veo 3のシステムに「これが私の標準キャラクターの姿だ、覚えておけ」と伝えているのです。

ステップ3:新しいショットを追加する

タイムライン上に**”+“記号**が表示されます。それをクリックします。

システムはショットタイプのオプションを表示します:

- Extend(継続):前のショットのアクションとシーンを継続し、自然に繋げる

- Jump to(切り替え):新しいシーンに切り替えるが、キャラクターの外見は維持する

次のショットが直後のアクション(例:彼女がドアを入ってカウンターに行って注文する)なら、Extendを選びます。

別のシーンに直接飛びたい場合(例:彼女がもう座ってコーヒーを飲んでいる)は、Jump toを選びます。

ほとんどの場合、私はExtendを選びます。その方が繋がりが一番良いからです。

ステップ4:新しいショットのプロンプトを書く

ここが最重要ポイントであり、最も多くの人が間違える場所です。

多くの人がここで手間を省こうとして、プロンプトを簡略化してしまいます。例えば「彼女はカウンターに行ってコーヒーを注文する」とだけ書いてしまうのです。

間違いです! 大間違いです!

AIは新しいショットを処理する際、前のショットの視覚情報を参考にしますが、依然としてあなたの文字描写を主要な根拠とします。完全なキャラクター描写を提供しないと、AIは元の姿から逸脱する可能性があります。

正しいやり方は:完全なキャラクター描写を一字一句コピー&ペーストし、アクションとシーンの部分だけを修正することです。

上記の例を続けます:

[完全なキャラクター描写を貼り付け、最初のショットと全く同じ]。彼女はカフェの木製カウンターに向かい、バリスタに微笑む。カメラは追従し、側面から撮影。柔らかな自然光を維持。

わかりましたか? キャラクター描写は一文字も変わっていません。アクションとカメラ設定だけを変えました。

これが「Verbatim Rule(逐語的ルール)」と呼ばれるものです。テストデータによると、完全記述と簡易記述を使用した場合、最終的なキャラクター一貫性の差は40%に達します。この差は、あなたの動画が「どうにか見られるレベル」か「プロ級の連続性」かを決定づけます。

面倒なのはわかります。コピペ、コピペ、またコピペ……でも仕方ありません、これが現段階のAI技術の限界です。いつかAIが本当に長期記憶を持てば、こんな手間は無くなるでしょう。しかしその日が来るまでは、おとなしくルールに従いましょう。

ステップ5:生成とチェック

生成をクリックし、30秒から2分待ちます。

動画が生成されたら、直ちに比較チェックを行います:

- 髪型はまだ一致していますか?

- 服装は元のセットのままですか?

- 顔の特徴に明らかなズレはありませんか?

- 全体的な雰囲気は同一人物に見えますか?

一貫性が8点以上(10点満点)なら、おめでとうございます、そのショットを採用できます。

6-7点の場合、細部が少しおかしいけれど主な特徴は残っているなら、採用を検討するか、プロンプトを調整して再生成します。

5点以下でキャラクターが明らかに変わってしまったら、迷わず再生成してください。注意:再生成時はキャラクター描写を変えず、シーンやカメラ設定の部分だけを調整してください。

ステップ6:完全なシーン構築を繰り返す

同じ方法で第3、第4、第5のショットを追加していきます。

ショットを追加するたびに、シーケンス全体を再生して全体的な繋がりを確認することをお勧めします。個々のショットは良く見えても、繋げてみると違和感があることがあるからです。

また、一度に長く作りすぎないでください。Veo 3の単一動画の長さは5-8秒です。5-7ショット(合計約30-50秒)作れば十分です。長すぎるとキャラクターの一貫性は徐々に低下し、時間とクレジットを大量に消費します。

上級テクニック(任意ですが推奨)

さらに一貫性を高めたい場合は、以下のテクニックを試してみてください:

1. ネガティブプロンプトの使用

キャラクター描写の後ろに、“no hat, no glasses, no beard, no accessories”(帽子なし、眼鏡なし、髭なし、アクセサリーなし)などを追加します(キャラクターがそれらの特徴を持っていない場合)。

これにより、AIがランダムに不要な要素を追加するのを防げます。以前、前のショットまで眼鏡をかけていなかったのに、第4ショットで突然サングラスを追加され、雰囲気が変わってしまったことがありました。ネガティブプロンプトを追加してからは、この問題は再発していません。

2. 光照の一貫性を保つ

急激な光の変化は、AIのキャラクター認識に影響を与えます。例えば明るい室内から突然夜の屋外に変わると、光の差が大きすぎてAIがキャラクターの外見を変えてしまうことがあります。

どうしてもシーンを変える必要がある場合は、光の条件を似せるか、緩衝となる遷移ショットを使ってください。

3. 極端な角度を避ける

俯瞰(見下ろし)や仰角(見上げ)のような極端な角度は、AIが顔の特徴を識別しにくくし、その後のショットの精度を下げます。

最初の数ショットはできるだけ水平またはわずかに俯瞰の通常アングルを使い、キャラクターの外見が安定してから特殊なアングルを試してください。

4. プロンプトテンプレートライブラリを作る

よく使うキャラクター描写をNotionやGoogle Docsなどのメモアプリに保存しておきます。必要な時に直接コピーし、毎回入力し直さないようにします。

私は自分用のテンプレートライブラリを持っており、5-6種類の異なるタイプのキャラクター(男性、女性、老人、子供など)が入っています。新しいプロジェクトのたびにそこから選んで少し変えるだけです。これで大幅に時間を節約できます。

プロンプト管理と最適化戦略

Scenebuilderの操作について話しましたが、次はプロンプトそのものについて話しましょう。多くの人はプロンプトを適当に書いていますが、実は奥が深いのです。

プロンプトの基本構造

優れたVeo 3プロンプトは、以下の4つの部分を含むべきです:

[キャラクター完全記述] + [アクション/シーン] + [カメラワーク] + [スタイル/雰囲気]

具体例をいくつか挙げます:

例1:シンプルシーン

35歳の白人男性、白髪混じりの短い茶髪、青い目、整えられた髭。濃紺のスーツに白いシャツ、深紅のネクタイを着用し、中肉中背、フォーマルな姿勢。彼は街の通りを歩き、周りを見回している。中景ショット、わずかに追従。柔らかな朝の光、現代都市の雰囲気。例2:室内会話

28歳のアジア人女性、黒いストレートのロングヘアを低いポニーテールにしている。濃い茶色の目。白いTシャツに濃紺のジーンズを着用、痩せ型、自信に満ちた姿勢。彼女はカフェの木のテーブルの前に座り、カメラに向かって微笑み、両手でコーヒーカップを持っている。正面中近景、固定カメラ。暖かい室内光、カフェの背景ボケ。例3:アクションシーン

22歳の黒人男性、短い巻き毛、濃い茶色の目。グレーのパーカーと黒いスウェットパンツを着用、筋肉質、アスリート体型。彼は公園でジョギングしており、足取りは軽い。側面追従撮影、カメラは人物の移動に合わせて動く。早朝の自然光、公園の緑の木々の背景。法則が見えましたか? キャラクター部分は常に最も詳細で、アクションとシーン部分は比較的簡潔、カメラと雰囲気部分は補助的な役割を果たします。

キャラクター描写の黄金律

何度も強調しましたが、あまりに重要なのでもう一度言います:

新しいショットを生成するたびに、キャラクター描写を完全にコピー&ペーストし、一文字も変えないこと。

なぜそこまで厳格なのか? それは、AIの言語理解が確率的であり、厳密ではないからです。「白いTシャツ」と「白のTシャツ」は、人間には違いがありませんが、AIにとってはわずかに異なる入力であり、わずかに異なる出力を招く可能性があります。

これらの微細な違いは、単一ショットではわからないかもしれませんが、5つ、10つとショットを重ねるにつれて拡大します。最終的には、キャラクターが再び「漂流」していることに気づくでしょう。

だから、手抜きせず、書き直さず、簡約しないでください。コピー&ペースト、一字一句そのままに。

ユーザーテストデータによると、「逐語的ルール」を厳守したクリエイターのキャラクター一貫性は平均8.5点(10点満点)に達しましたが、プロンプトを随意に書き換えたクリエイターは平均5-6点にとどまりました。この差は決定的です。

シーン接続のテクニック

独立したショットを生成するのは難しくありませんが、それらを自然に繋げるのが難しいのです。

テクニック1:環境の連続性を保つ

前のショットがカフェで、次のショットがいきなりビーチだと、視覚的な断絶感が強くなります。AIもキャラクターの外見を混同しやすくなります。

シーンに論理的な関連性を持たせるようにしましょう。例:カフェ内→カフェ入り口→通り→公園。このような漸進的なシーン変化なら、AIはより安定して処理できます。

テクニック2:トランジション(遷移)ショットを使う

大きなシーン転換が必要な場合、トランジションショットを入れることを検討してください。

例えば室内から屋外へ移る際、「彼女がドアを開け、光が差し込む」といったショットを追加します。視覚効果が良くなるだけでなく、AIのキャラクター一貫性もより安定します。

テクニック3:時間の継続を明確にする

プロンプトに「continues to…(〜し続ける)」、「then…(そして…)」といった言葉を加え、連続したアクションであることをAIに理解させます。

悪い例:「彼女はテーブルに座ってコーヒーを飲む。」(唐突)

良い例:「彼女はテーブルまで歩いて座り、コーヒーカップを持ち上げて一口飲む。」(一連の流れ)

私の個人テンプレートライブラリ

私がよく使うテンプレートをいくつかシェアします。自由に改変して使ってください:

テンプレート1:現代都市男性

32歳のアジア人男性、後ろに撫でつけた整った黒い短髪、濃い茶色の目、うっすらとした無精髭。グレーのニットセーターに黒いチノパンを着用し、バランスの取れた体型、リラックスしているがオーラのある姿勢。テンプレート2:キャリアウーマン

29歳の白人女性、肩までの金褐色のウェーブヘア、淡い青の目。ベージュのシャツにダークグレーのパンツ、黒いローヒールパンプスを着用、痩せ型、プロフェッショナルで自信に満ちた姿勢。テンプレート3:ストリート系の若者

19歳のラテン系男性、ややカールの黒いミディアムヘア、濃い茶色の目。黒いグラフィックTシャツに青いダメージジーンズ、白いスニーカーを着用、痩せ型で長身、気ままなリラックスした姿勢。これらのテンプレートを保存し、ストーリーのニーズに合わせて詳細を少し調整するだけです。髪型を変えたり、服を変えたりしても、基本的な骨組みは使い回せます。

よくある問題と実践ソリューション

多くの動画を作ってきて、ハマるべき落とし穴にはほぼ全てハマりました。以下のような問題に、あなたも遭遇するかもしれません。

問題1:Scenebuilderを使ったのに、キャラクターが変わってしまった

症状:最初の2ショットは一致していたのに、3ショット目、4ショット目から崩れ始め、服の色が変わり、髪型が変わり、顔の形までおかしくなった。

考えられる原因:

- プロンプトに微細な違いがある(キャラクター描写を簡略化してしまったなど)

- 光やシーンの変化が大きすぎる

- カメラアングルが極端すぎる

解決策:

まず、プロンプトをチェックしてください。使用したすべてのプロンプトを開き、キャラクター描写部分を一字一句比較します。「濃紺のスーツ」が「青いスーツ」になっていたり、詳細が抜けていたりするはずです。描写を統一し、再生成してください。

次に、シーン設定を見直します。2番目のショットが明るい室内で、3番目のショットがいきなり薄暗い夜の通りだと、AIは光の差でキャラクターを混同します。光の条件を似せるか、プロンプトで「同じキャラクターの外見を維持する」と強調して解決します。

最後に、カメラアングルを確認します。極端な俯瞰や仰角を使うと、AIは顔の特徴を正確に認識できないことがあります。初期段階では通常のアングルを使い、キャラクターの外見が安定してから特殊なアングルを使ってください。

以前あるプロジェクトで、第4ショットでキャラクターが急変しました。調べたら、そのショットで超広角の仰角を使っており、キャラクターの顔がパースで歪んでAIが認識できなかったのです。水平アングルに変えたら、即座に解決しました。

問題2:私のVeo 3にReference Images機能がない

症状:チュートリアルでは画像をアップロードできると言っているのに、自分の画面にはそのオプションがない。

原因:Reference ImagesはVeo 3.1 Standardモード専用の機能です。Basic版や旧バージョンを使っている場合、この機能はありません。

解決策:

AI Ultraサブスクリプションプランにアップグレードしてください。正直、このプランは安くありません(月額$250)。しかし、真剣にAI動画制作をするなら、投資する価値はあります。Standardモードの生成品質、速度、機能はBasic版よりはるかに優れています。

アップグレードしたくない場合も大丈夫です。Reference Imagesは必須ではありません。Scenebuilderと詳細な文字描写があれば、十分な一貫性を達成できます。私自身、大半のプロジェクトでReference Imagesを使わず、連貫した動画を作れています。

別の代替案として、他のツール(MidjourneyやStable Diffusionなど)で先にキャラクターの立ち絵を生成し、その画像に基づいて超詳細な文字描写を書き、その描写を使って動画を生成する方法があります。直接画像をアップロードするほどではありませんが、純粋な文字よりは良い結果が出ます。

問題3:生成速度が遅く、コストが高すぎる

症状:各ショットの生成に1〜2分かかり、5ショットのプロジェクトで試行錯誤していると一晩に1つしか作れず、クレジットも大量に消費する。

現実チェック:はい、それが現状です。AI動画生成は現在、遅くて高いです。あなたのせいではなく、技術の発展段階による制限です。

しかし、ワークフローは最適化できます:

戦略1:準備万端で始める

いきなりVeo 3を開いて生成を始めないでください。まず1時間かけて脚本、キャラクター描写、各ショットのプロンプトをすべて準備し、間違いがないか確認してから生成を始めます。盲目的な試行錯誤は時間とコストの最大の無駄です。

私の今の習慣は、Notionでプロジェクト全体を計画し、5〜7ショットの完全なプロンプトを1つのドキュメントにまとめておくことです。そして一度にコピペして生成し、その場の思いつきによる修正や反復調整を減らしています。

戦略2:低コストツールで準備する

Veo 3を使う前に、無料または安価なツールでキャラクターデザインをします。

例えば、Whisk(Googleの無料ツール)でキャラクターの立ち絵を生成したり、Leonardo.aiやIdeogramでシーンの参考画像を生成したりします。キャラクターの外見を視覚化して固定してからVeo 3で動画化すると、成功率がぐっと上がります。

戦略3:重要なショットだけ生成する

すべてのショットをVeo 3で生成する必要はありません。重要でないつなぎのショットや遠景ショットは、より安価なツール(PikaやRunwayのBasic版など)で生成するか、いっそ実写素材を使ってみてください。

予算は、キャラクターのアップや重要なアクションが必要なショットに集中させましょう。

以前あるプロジェクトで、7ショット中3つがキャラのクローズアップ、2つが中景会話、2つが環境遠景でした。前の5つはVeo 3で丁寧に作り、後の2つはPexelsの動画素材をそのまま使いました。編集して繋げると、全く違和感はありませんでしたが、コストは半分で済みました。

問題4:複数キャラクターの同時出現がより難しい

課題:物語に主人公が2人、あるいは3人いて、全員を一貫させるのは至難の業。

なぜ難しいか:

各キャラクターに詳細な描写が必要で、プロンプトが長くなりすぎます。Veo 3のプロンプトには長さ制限があり、長すぎるとカットされます。また、キャラクターが多いほど、AIは混同しやすくなります。

解決策:

優先順位付け

主従を明確にします。主人公1人と脇役1人なら、80%の力を主人公に注ぎ、脇役の一貫性は少し妥協します。視聴者の注意は主に主人公にあるので、脇役が多少ずれても大半の人は気づきません。

Ingredients to Videoを使う

多キャラクターシーンに最適なツールです。各キャラクターの参考画像を個別に生成し(Gemini 2.5 Flash ImageやMidjourneyなどで)、Ingredients機能で合成します。これにより、各キャラクターに明確な視覚的アンカーができ、AIが混同しにくくなります。

ショットを分ける

複数のキャラクターが1つの画面に同時に出ることを極力避けます。モンタージュ手法を使い、Aが話すときはAのアップ、Bが答えるときはBのアップに切り替えます。こうすれば各ショットで1人のキャラクターだけを処理すればよく、一貫性の問題は即座に半減します。

ある賢い事例を見ました。作者は2人の会話シーンを作りましたが、全編通して2人が同時に映るショットはなく、全て単独ショットの切り返しとボイスオーバーで構成されていました。視聴者は技術的制限を感じず、むしろプロっぽいカッティングだと感じていました。

最後に

いろいろ話しましたが、本音をいくつか。

キャラクターの一貫性は確かにAI動画生成の最大の課題の一つであり、ScenebuilderやReference Imagesを使っても、100%完璧にはなりません。失敗することもあるし、何度もやり直す必要もあるし、時にはイライラすることもあるでしょう。

しかし、体系化された方法——詳細なキャラクターバイブル、厳格なプロンプト管理、Scenebuilderの正しい使用——を通じて、一貫性を3点から8点に引き上げることは絶対に可能です。この差は、あなたの作品を「AI生成っぽい」から「プロが作ったようだ」に変えるのに十分です。

私自身、最初の手探り状態から、今では一貫したマルチショット動画を安定して作れるようになるまで、約2週間と数百回の生成テストを要しました。私の経験から何かを学び、回り道を少しでも減らせたなら、この記事を書いた甲斐があります。

最後に、アクションプランとして**「小さなプロジェクトから始める」**ことを提案します。

いきなり10分の短編を作ろうとしないでください。まずは2〜3ショットの超短いシーンを作って、練習台にしましょう。フローに慣れ、自信をつけ、テンプレートを蓄積するのです。3つのショットを一貫させられるようになったら、5つ、7つと拡張していってください。

ローマは一日にして成らず、スキルも一回では身につきません。

さて、チュートリアルはここまでです。Google Flowを開き、最初のキャラクターバイブルを作り、試してみてください。質問や成功事例があれば、ぜひ共有してください。あなたがどんな作品を作るのか、楽しみにしています。

一貫性のある生成ができますように。

FAQ

なぜAI動画の中のキャラクターはいつもコロコロ変わるのですか?

1) AIには長期記憶がなく、各プロンプトは独立したタスクとして処理されます

2) 文字描写が不正確で、広範な記述が結果のばらつきを生みます

3) 技術的な限界で、フレームごとの生成時にズレが蓄積します

Scenebuilderなどのツールを使用すると、一貫性を60-70%向上させることができます。

Scenebuilderを使ってキャラクターの一貫性を保つには?

1) キャラクターバイブルを作成(100-150文字の詳細描写)

2) 基準ショットを生成(3-5回試してベストを選ぶ)

3) シーンに追加(Add to Sceneをクリック)

4) 新しいショットを追加(ExtendまたはJump toを選択)

5) キャラクター描写を完全に繰り返す(一字一句コピー&ペースト)

6) 生成してチェック(一貫性が8点以上ならOK)

なぜキャラクター描写を完全に繰り返す必要があるのですか?

効果の比較:

• 完全記述と簡易記述を使用した場合の一貫性の差は40%に達します

• ルールを厳守するクリエイターの一貫性は8.5点

• 適当に書き換えると5-6点

理由:AIの言語理解は確率的であり、「白いTシャツ」と「白のTシャツ」でも異なる結果を生む可能性があるためです。

Reference Images機能はどこにありますか?

アップグレードしたくない場合:

• Scenebuilder + 詳細な文字描写

• 他のツールでキャラクター立ち絵を生成し、詳細な描写を書く

複数のキャラクターが同時に出る場合、一貫性をどう保ちますか?

1) 優先順位をつけ、80%の力を主人公に注ぐ

2) Ingredients to Videoを使用し、各キャラクターの参考画像を個別に生成してから合成する

3) ショットを分け、多キャラクター同居を避け、モンタージュ手法で個別に処理する

生成コストを下げて効率を上げるには?

1) 準備万端で始める、全てのプロンプトを事前に書いておく

2) 低コストツールで準備する(WhiskやLeonardo.aiでキャラ絵を生成)

3) 重要なショットだけ生成し、つなぎのショットは安価なツールや実写素材を使う

15分かけてキャラクターバイブルを作ることで、3時間の再生成時間を節約できます。

12 min read · 公開日: 2025年12月7日 · 更新日: 2026年3月3日

関連記事

プログラマー向けAIツール実践:OpenClaw + Claude Codeによる24時間自動バグ修正

プログラマー向けAIツール実践:OpenClaw + Claude Codeによる24時間自動バグ修正

第二の脳を構築する:OpenClawとObsidian/Notionのディープ・メモリー同期実践

第二の脳を構築する:OpenClawとObsidian/Notionのディープ・メモリー同期実践

警告!ClawHubスキルライブラリで800以上の悪意あるプラグインを発見。あなたのAPI Keyは本当に安全ですか?

コメント

GitHubアカウントでログインしてコメントできます